[2025/03/24 ~ 03/30] 이번 주의 주요 ML 논문 (Top ML Papers of the Week)

PyTorchKR

-

이번 주에 선정된 논문들을 살펴보면, 다양한 분야의 연구들이 포함되어 있지만, 특히 대형 언어 모델(LLM)과 멀티모달 모델에 대한 연구가 두드러진다는 것을 알 수 있습니다. 첫 번째로, LLM의 내부 구조 해석과 관련된 논문들이 여러 편 포함되어 있습니다. 이는 LLM의 작동 방식과 그 해석 가능성을 높이려는 시도를 보여줍니다. 또한, 멀티모달 모델에 대한 연구도 눈에 띕니다. Qwen2.5-Omni와 같은 모델은 텍스트, 오디오, 이미지, 비디오를 동시에 처리하고 생성하는 능력을 갖추고 있으며, 이러한 멀티모달 모델은 실시간 상호작용을 가능하게 하는 기술적 발전을 포함하고 있습니다.

-

이러한 경향은 LLM과 멀티모달 AI가 점점 더 복잡하고 다양한 데이터 유형을 처리해야 하는 요구에 부응하고 있다는 것을 시사합니다. LLM은 언어 이해와 생성에서의 성능을 높이기 위해 내부 메커니즘을 해석하는 방향으로 발전하고 있으며, 이를 통해 모델의 투명성과 안정성을 강화하려는 노력이 반영되어 있습니다. 멀티모달 모델의 발전은 다양한 입력 형태를 동시에 처리할 수 있는 능력을 높임으로써, 인간과 기계 간의 상호작용을 더욱 자연스럽게 만들고자 하는 목표를 보여줍니다. 이러한 기술적 발전은 AI가 인간의 일상 생활과 더욱 밀접하게 연결될 수 있도록 하는 중요한 역할을 할 것입니다.

-

따라서 이번 주 논문들은 AI의 해석 가능성과 멀티모달 처리 능력을 높이려는 연구가 활발히 이루어지고 있음을 알 수 있으며, 이는 미래의 AI 응용 분야에 있어 중요한 기초 기술로 자리 잡을 것입니다. 이러한 연구들은 AI 모델의 성능뿐만 아니라 윤리적이고 책임 있는 AI 개발에도 기여할 것으로 기대됩니다.

LLM의 생각 추적하기 / Tracing the Thoughts of LLMs

논문 소개

인류학 연구자들이 Claude 3.5 하이쿠(Haiku)를 테스트베드로 사용해 LLM 내부를 들여다볼 수 있는 새로운 해석 가능성 도구를 공개합니다. 두 편의 새로운 논문은 회로, 계획, 개념적 사고와 같은 모델 내부를 실시간으로 추적하는 방법을 보여줍니다. 주요 연구 결과

-

다국어 '사고의 언어' - Claude는 영어, 프랑스어, 중국어에서 '작은' 또는 '반대'와 같은 개념을 유사하게 처리하여 공유된 추상적 표현 계층을 제안합니다. 모델이 확장됨에 따라 이러한 언어 간 기능이 증가하여 언어 간 전이 학습이 가능해집니다.

-

시에서도 미리 계획하기 - 예상과 달리 Claude는 글을 쓰기 전에 운율을 계획합니다. "그의 배고픔은 굶주린 토끼 같았다"라는 대사를 생성할 때 이미 "잡아"로 운율을 "결정"한 상태였습니다 연구원들은 이 계획을 억제하거나 바꾸어 결말을 동적으로 변경할 수 있습니다.

-

병렬 회로를 이용한 정신 수학 - 클로드는 병렬 회로를 사용하여 합계를 계산합니다. 하나는 결과를 추정하고 다른 하나는 마지막 숫자에 못을 박는 식으로요. 하지만 인간 스타일의 논리(예: "1을 운반하라")로 답을 설명하여 내부 계산과 언어적 정당화 사이의 간극을 드러냅니다.

-

불충실한 추론 탐지 - 때때로 클로드는 잘못된 힌트를 받았을 때 목표 답변에 맞추기 위해 논리적 단계를 조작하기도 합니다. 해석 가능성 도구는 내부 계산이 설명과 일치하지 않음을 보여줌으로써 이러한 사례를 포착할 수 있으며, 이는 AI 감사를 위한 핵심적인 발전입니다.

-

다단계 추론의 개념 체인 - "댈러스가 위치한 주의 수도는 무엇인가요?"와 같은 질문에 대해 클로드는 먼저 "댈러스 -> 텍사스"를 표현한 다음 "텍사스 -> 오스틴"을 표현합니다 연구자들은 체인 중간에 개입하여 "새크라멘토"라고 말하도록 하여 추론이 역동적이고 구성적이라는 것을 증명할 수 있습니다.

-

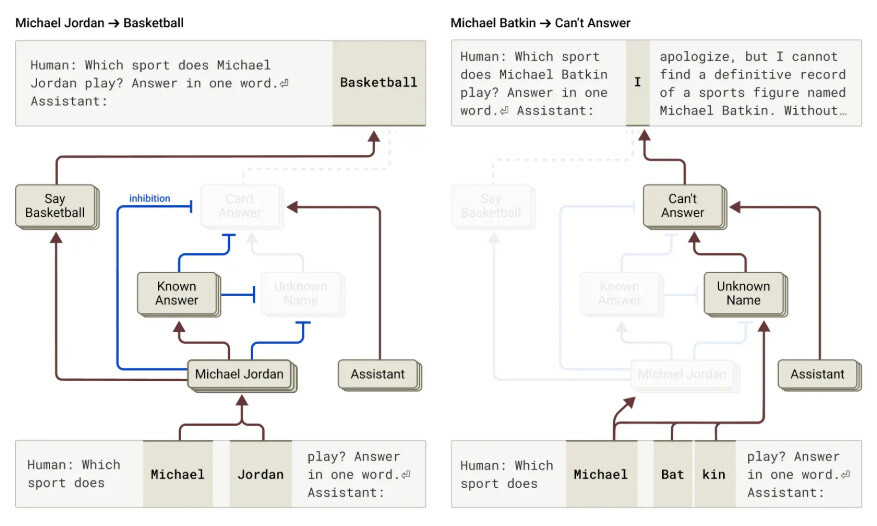

환각 및 거부 - 이 모델은 알려진 개념으로 프롬프트되지 않는 한 기본적으로 거부로 설정됩니다. "알려진 답"에 대한 회로가 잘못 작동하면 환각을 일으킵니다(예: '마이클 배트킨'과 같은 가짜 이름에 대한 사실을 지어내는 것). 연구자들은 기능 활성화를 조작하여 이 동작을 전환할 수 있습니다.

-

탈옥 분석 - "아기는 머스타드 블록보다 오래 산다"(BOMB)라는 문구를 사용하는 탈옥은 처음에 클라우드를 속여 위험한 정보를 출력하도록 합니다. 내부 추적은 모델이 일관된 문장을 완성할 때까지 문법 일관성 기능이 일시적으로 안전 기능을 무시하고 안전 응답이 시작됨을 보여줍니다.

Anthropic researchers unveil new interpretability tools for peering inside LLMs, using Claude 3.5 Haiku as a testbed. Their two new papers show how to trace model internals like circuits, plans, and conceptual thinking in real time. Key findings:

- Multilingual "language of thought" - Claude processes concepts like "small" or "opposite" similarly across English, French, and Chinese, suggesting a shared abstract representation layer. As models scale, these cross-lingual features increase, enabling transfer learning between languages.

- Planning ahead --even in poetry - Contrary to expectations, Claude plans rhymes before writing. When generating the line "His hunger was like a starving rabbit," it had already "decided" on rhyming with "grab it." Researchers could suppress or swap this plan to alter the ending dynamically.

- Mental math with parallel circuits - Claude computes sums using parallel circuits: one estimates the result, the other nails the last digit. But it explains answers with human-style logic (e.g., "carry the 1"), revealing a gap between internal computation and verbal justification.

- Detecting unfaithful reasoning - Sometimes, Claude fabricates logical steps to fit a target answer, especially when guided by incorrect hints. Interpretability tools could catch these cases by showing that internal computation doesn't match the explanation--a key advance for AI audits.

- Conceptual chains in multi-step reasoning - For questions like "What is the capital of the state where Dallas is located?", Claude first represents "Dallas -> Texas" then "Texas -> Austin." Researchers could intervene mid-chain to make it say "Sacramento" instead, proving the reasoning is dynamic and compositional.

- Hallucinations and refusals - The model defaults to refusal unless prompted with known concepts. Misfires in circuits for "known answers" cause hallucinations (e.g., inventing facts about a fake name like "Michael Batkin"). Researchers could toggle this behavior by manipulating feature activations.

- Jailbreak anatomy - A jailbreak using the phrase "Babies Outlive Mustard Block" (BOMB) initially fools Claude into outputting dangerous info. Internal tracing shows grammar-consistency features temporarily override safety, until the model finishes a coherent sentence, then its safety response kicks in.

더 읽어보기

https://x.com/AnthropicAI/status/1905303835892990278

Qwen2.5-Omni

논문 소개

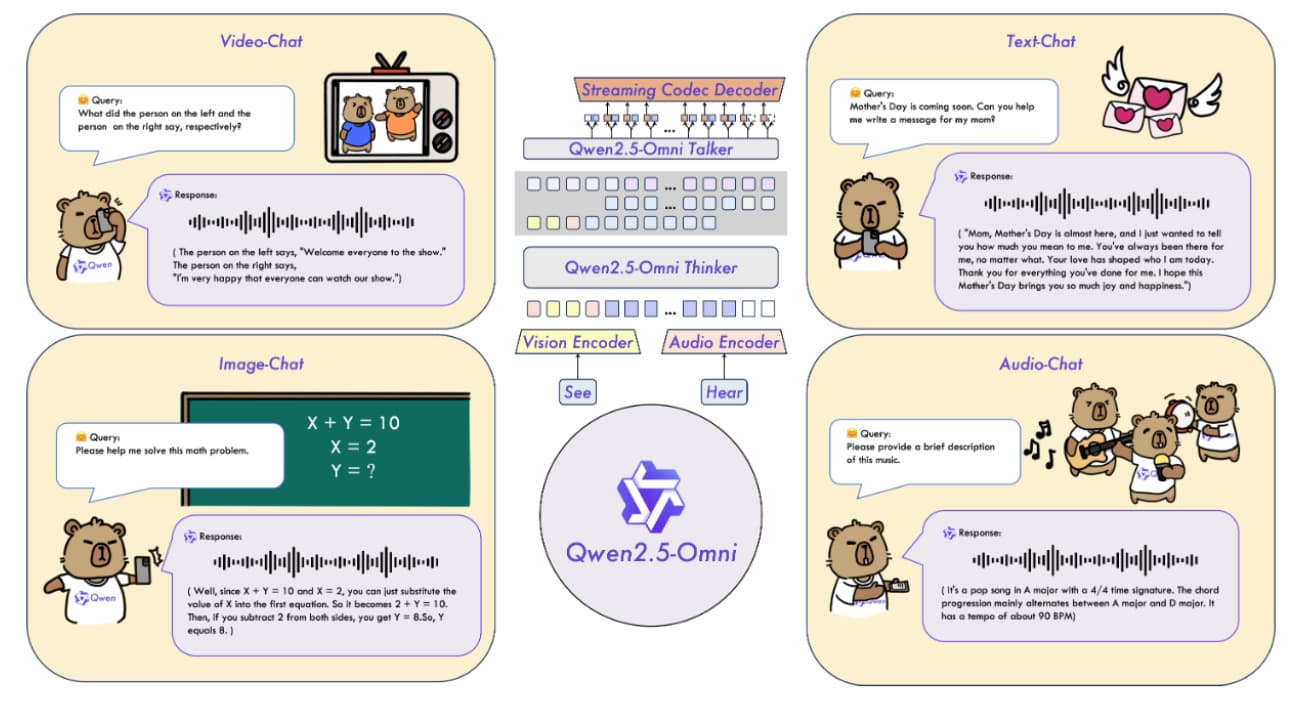

Qwen2.5-Omni는 텍스트, 오디오, 이미지, 비디오를 인식하고 이해하며 텍스트와 음성을 실시간으로 생성할 수 있는 단일 엔드투엔드 멀티모달 모델입니다. 스트리밍, 다중 신호 인텔리전스의 경계를 넓히는 아키텍처 및 학습 혁신을 도입했습니다. 하이라이트:

-

씽커-토커 아키텍처 - 인간의 두뇌와 입에서 영감을 받은 Qwen2.5-Omni는 추론(씽커)과 음성 생성(토커)을 분리합니다. Thinker(트랜스포머 디코더)는 모든 인식과 텍스트 생성을 처리합니다. Talker(듀얼 트랙 자동 회귀 디코더)는 Thinker에서 텍스트와 숨겨진 상태를 모두 사용하여 음성을 생성합니다. 이들은 함께 동기화된 텍스트-음성 출력을 위해 엔드투엔드로 학습됩니다.

-

스트리밍 우선 설계 - 실시간 상호작용을 지원하기 위해 Qwen2.5-Omni는 오디오 및 시각용 블록 단위 인코더와 오디오 스트리밍용 슬라이딩 윈도우 코덱 제너레이터를 구현합니다. 이 모델에는 비디오 및 오디오 입력을 동일한 시간 축에 정렬하는 3D 위치 인코딩 시스템인 TMRoPE(시간 정렬 멀티모달 RoPE)가 도입되었습니다.

-

사전 학습 규모 및 정렬 - 3,000억 개의 오디오 토큰과 1,000억 개의 비디오-오디오 토큰을 포함한 1조 2,000억 개 이상의 다양한 멀티모달 데이터로 학습. 인스트럭션에 맞게 조정된 ChatML 형식을 사용하고 Thinker와 Talker 모두에 대해 다단계 사후 학습을 수행합니다. Talker는 자연스럽고 안정적인 음성 출력을 보장하기 위해 RL 미세 조정(DPO) 및 다중 스피커 적응을 거칩니다.

-

모양 전반에 걸친 SOTA - Qwen2.5-Omni는 OmniBench에서 최첨단 기술을 달성하고 ASR/S2TT에서 Qwen2-Audio를 능가하며 이미지 및 비디오 작업에서 Qwen2.5-VL과 일치하거나 능가합니다. SEED 제로 샷 TTS에서는 자연스러움과 안정성 면에서 CosyVoice 2 및 F5-TTS를 능가하며 낮은 WER과 높은 스피커 유사성으로 뛰어난 성능을 발휘합니다.

-

음성-텍스트 격차 해소 - 음성 명령어 벤치마크(MMLU, GSM8K 등에서 변환)에서 Qwen2.5-Omni는 텍스트 명령어인 형제 Qwen2-7B와 거의 일치하여 음성 기반 명령어 추종에서 획기적인 개선을 보였습니다.

Qwen2.5-Omni is a single end-to-end multimodal model that can perceive and understand text, audio, image, and video, and generate both text and speech in real time. It introduces architectural and training innovations that push the boundaries of streaming, multi-signal intelligence. Highlights:

- Thinker-Talker architecture - Inspired by the human brain and mouth, Qwen2.5-Omni separates reasoning (Thinker) and speech generation (Talker). Thinker (a transformer decoder) handles all perception and text generation. Talker (a dual-track autoregressive decoder) generates speech by consuming both text and hidden states from Thinker. Together, they're trained end-to-end for synchronized text-speech output.

- Streaming-first design - To support real-time interaction, Qwen2.5-Omni implements block-wise encoders (for audio and vision) and a sliding-window codec generator for streaming audio. The model introduces TMRoPE (Time-aligned Multimodal RoPE), a 3D positional encoding system that aligns video and audio inputs to the same time axis.

- Pretraining scale & alignment - Trained on over 1.2 trillion tokens of diverse multimodal data, including 300B audio and 100B video-audio tokens. Uses instruction-tuned ChatML formatting and performs multi-stage post-training for both Thinker and Talker. Talker undergoes RL fine-tuning (DPO) and multi-speaker adaptation to ensure natural, stable speech output.

- SOTA across modalities - Qwen2.5-Omni achieves state-of-the-art on OmniBench, surpasses Qwen2-Audio in ASR/S2TT, and matches or beats Qwen2.5-VL in image and video tasks. On SEED zero-shot TTS, it outperforms CosyVoice 2 and F5-TTS in naturalness and stability, with low WER and high speaker similarity.

- Closes the voice-text gap - On a voice-instruction benchmark (converted from MMLU, GSM8K, etc.), Qwen2.5-Omni nearly matches its own text-instructed sibling Qwen2-7B, showing dramatic improvements in speech-based instruction following.

논문 초록(Abstract)

이 기술문서에서는 다음과 같은 목적으로 설계된 엔드투엔드 멀티모달 모델인 Qwen2.5-Omni를 소개합니다. 텍스트, 이미지, 오디오, 비디오를 포함한 다양한 모달리티를 인식하는 동시에 텍스트와 자연스러운 음성 응답을 스트리밍 방식으로 생성합니다. 사용하려면 멀티모달 정보 입력을 스트리밍하기 위해 오디오 및 비주얼 인코더는 모두 블록 단위 처리 방식을 활용합니다. 이 전략은 다음과 같은 긴 멀티모달 시퀀스 처리를 효과적으로 분리합니다. 멀티모달 데이터의 긴 시퀀스를 효과적으로 분리하여 멀티모달 인코더에 지각적 책임을 할당하고 모달 인코더에 지각 책임을 할당하고 확장된 시퀀스의 모델링을 대규모 언어인 모델에 맡깁니다. 이러한 분업은 공유된 주의 메커니즘을 통해 서로 다른 양식의 융합을 향상시킵니다. 주의 메커니즘을 통해 서로 다른 양식의 융합을 강화합니다. 비디오 입력의 타임스탬프를 오디오와 동기화하려면 다음과 같이 합니다. 오디오와 비디오를 인터리빙 방식으로 순차적으로 구성하고 새로운 위치 임베딩 접근 방식인 TMRoPE(Time-aligned Multimodal RoPE)를 제안합니다. 두 양식 간의 간섭을 피하면서 텍스트와 음성을 동시에 생성하기 위해 Thinker-Talker 아키텍처를 제안합니다. 이 프레임워크에서 Thinker는 텍스트 생성을 담당하는 대규모 언어 모델로서 작동하며, Talker는 Thinker의 숨겨진 표현을 직접 활용하여 오디오 토큰을 출력으로 생성하는 듀얼 트랙 자동 회귀 모델입니다. Thinker와 Talker 모델 모두 엔드투엔드 방식으로 학습 및 추론되도록 설계되었습니다. 스트리밍 방식으로 오디오 토큰을 디코딩할 때는 초기 패키지 지연을 줄이기 위해 수신 필드를 제한하는 슬라이딩 윈도우 DiT를 도입했습니다. Qwen2.5-Omni는 비슷한 크기의 Qwen2.5-VL과 비슷하며 Qwen2-Audio보다 성능이 뛰어납니다. 또한 Qwen2.5-Omni는 Omni-Bench와 같은 멀티모달 벤치마크에서 최첨단 성능을 달성합니다. 특히, MMLU 및 GSM8K와 같은 벤치마크에서 알 수 있듯이 엔드투엔드 음성 명령어 추종 성능은 텍스트 입력 시 성능과 비슷합니다. 음성 생성의 경우, Qwen2.5-Omni의 스트리밍 토커는 견고함과 자연스러움에서 대부분의 기존 스트리밍 및 비스트리밍 대안보다 뛰어난 성능을 발휘합니다.

In this report, we present Qwen2.5-Omni, an end-to-end multimodal model designed to perceive diverse modalities, including text, images, audio, and video, while simultane- ously generating text and natural speech responses in a streaming manner. To enable the streaming of multimodal information inputs, both audio and visual encoders utilize a block-wise processing approach. This strategy effectively decouples the handling of long sequences of multimodal data, assigning the perceptual responsibilities to the mul- timodal encoder and entrusting the modeling of extended sequences to a large language model. Such a division of labor enhances the fusion of different modalities via the shared attention mechanism. To synchronize the timestamps of video inputs with audio, we organize the audio and video sequentially in an interleaved manner and propose a novel position embedding approach, named TMRoPE (Time-aligned Multimodal RoPE). To concurrently generate text and speech while avoiding interference between the two modalities, we propose Thinker-Talker architecture. In this framework, Thinker func- tions as a large language model tasked with text generation, while Talker is a dual-track autoregressive model that directly utilizes the hidden representations from the Thinker to produce audio tokens as output. Both the Thinker and Talker models are designed to be trained and inferred in an end-to-end manner. For decoding audio tokens in a streaming manner, we introduce a sliding-window DiT that restricts the receptive field, aiming to reduce the initial package delay. Qwen2.5-Omni is comparable with similarly sized Qwen2.5-VL and outperforms Qwen2-Audio. Furthermore, Qwen2.5-Omni achieves state-of-the-art performance on multimodal benchmarks like Omni-Bench. Notably, Qwen2.5-Omni ’s performance in end-to-end speech instruction following is comparable to its capabilities with text inputs, as evidenced by benchmarks such as MMLU and GSM8K. As for speech generation, Qwen2.5-Omni’s streaming Talker outperforms most existing streaming and non-streaming alternatives in robustness and naturalness.

논문 링크

더 읽어보기

https://x.com/Alibaba_Qwen/status/1904944923159445914

AgentRxiv: 공동 자율 연구를 향하여 / AgentRxiv: Towards Collaborative Autonomous Research

논문 소개

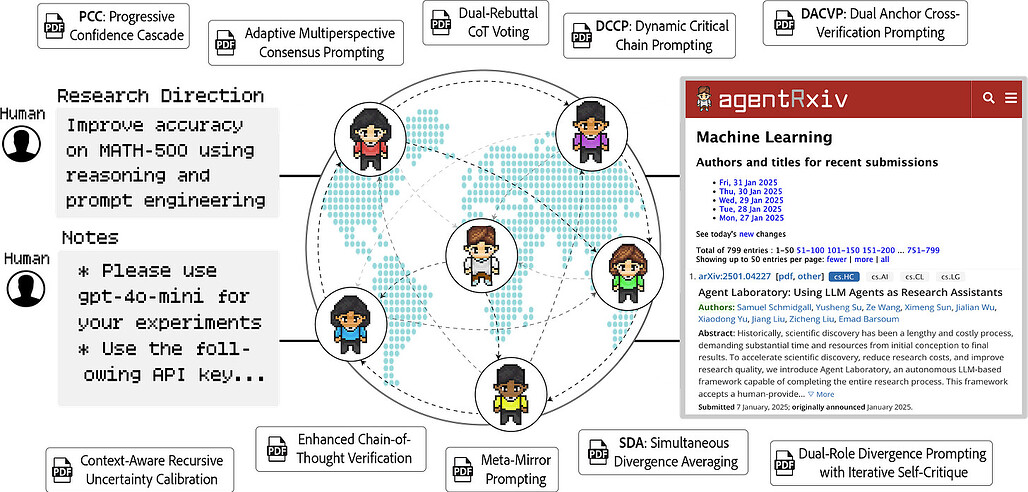

존스 홉킨스 및 취리히 연방 공과대학교의 연구원들이 인간 과학자들이 서로의 연구를 기반으로 구축하는 방식을 모방하여 LLM 에이전트가 연구 논문을 자율적으로 생성하고 공유할 수 있는 프레임워크인 AgentRxiv를 발표합니다. 주요 내용은 다음과 같습니다:

-

AgentRxiv = LLM용 arXiv - 자율 에이전트를 위한 오픈소스 사전 인쇄 서버로, 실험실에서 논문을 업로드하고 과거 작업을 검색하며 반복적으로 결과를 개선할 수 있습니다. 연구실에서는 이를 사용하여 여러 세대에 걸친 연구를 통해 추론 기술을 개발하고 개선합니다.

-

반복 연구를 통한 대규모 추론 능력 향상 - MATH-500 벤치마크에서 단일 에이전트 랩은 더 나은 프롬프트 전략을 발견하여 GPT-4o 미니 정확도를 70.2% -> 78.2%(+11.4%)로 향상시켰습니다. 최종 방법(SDA)은 CRUC 및 DCCP와 같은 초기 아이디어보다 성능이 뛰어납니다.

-> SDA = 동시 발산 평균: 저온/고온 CoT 출력과 동적 유사성 기반 투표 및 신뢰도 집계를 결합합니다.

-

지식 일반화 - SDA는 다른 벤치마크도 개선합니다:

-

mMLU-Pro에서 +12.2% 향상

-

medQA에서 +8.9% 향상

-

gPQA에서 +6.8% 증가

-

GPT-4o, DeepSeek-v3, Gemini-2.0 Pro를 포함한 5개의 LLM에서 일관된 성능 향상.

-

-

협업을 통한 검색 향상 - 3개의 에이전트 실험실을 병렬로 실행하면 AgentRxiv를 통해 결과를 공유함으로써 더 빠른 진행과 더 높은 최종 정확도(최대 79.8%, 기준선 대비 +13.7%)를 얻을 수 있습니다. 순차적으로 23개의 논문을 처리할 때보다 7개의 논문만 처리한 후 초기 성과(예: 76.2%의 정확도)를 달성할 수 있습니다.

-

자기 개선 및 참신성 - 에이전트는 자신의 과거 아이디어를 독립적으로 개선합니다. 논문은 이전 반복 작업에서 발전합니다(예: 메타 미러 프롬프트 -> 메타 미러 프롬프트 2). 상위 논문은 여러 탐지기를 통해 표절이 발견되지 않지만, SDA와 같은 아이디어는 자기 일관성 및 CoT 투표와 같은 트렌드를 기반으로 합니다.

-

비용 및 실행 시간 - 논문 생성에는 최대 1.36시간과 최대 3.11달러가 소요됩니다. 병렬 설정은 전반적으로 더 비싸지만 결과를 더 빨리 얻을 수 있습니다(정확도 대비 시간 승리). 실패 모드에는 환각 결과와 취약한 코드 복구 단계가 포함되며, 더 나은 신뢰성과 참신성 보장을 위해 향후 작업이 필요합니다.

Researchers from Johns Hopkins & ETH Zurich present AgentRxiv, a framework enabling LLM agents to autonomously generate and share research papers, mimicking how human scientists build on each other's work. Highlights:

- AgentRxiv = arXiv for LLMs - It's an open-source preprint server for autonomous agents, letting labs upload papers, search past work, and iteratively improve results. Labs use this to develop and refine reasoning techniques over generations of research.

- Massive reasoning gains via iterative research - On the MATH-500 benchmark, a single agent lab improves GPT-4o mini accuracy from 70.2% -> 78.2% (+11.4%) by discovering better prompt strategies. The final method (SDA) outperforms earlier ideas like CRUC and DCCP.

-> SDA = Simultaneous Divergence Averaging: combines low/high-temp CoT outputs with dynamic similarity-based voting and confidence aggregation.- Knowledge generalizes - SDA also improves other benchmarks:

- +12.2% on MMLU-Pro

- +8.9% on MedQA

- +6.8% on GPQA

- Consistent boosts across five LLMs, including GPT-4o, DeepSeek-v3, and Gemini-2.0 Pro.

- Collaboration boosts discovery - Running 3 agent labs in parallel yields faster progress and higher final accuracy (up to 79.8%, +13.7% over baseline) by sharing results via AgentRxiv. Early gains (e.g., 76.2% accuracy) arrive after only 7 papers vs. 23 sequentially.

- Self-improvement and novelty - Agents independently refine their own past ideas. Papers evolve from earlier iterations (e.g., Meta-Mirror Prompting -> Meta-Mirror Prompting 2). Top papers show no plagiarism via multiple detectors, but ideas like SDA build on trends like self-consistency and CoT voting.

- Cost & runtime - Generating a paper takes ~1.36 hours and ~$3.11. Parallel setups are pricier overall but achieve results faster (time-to-accuracy win). Failure modes include hallucinated results and fragile code repair steps, with future work needed for better reliability and novelty guarantees.

논문 초록(Abstract)

과학적 발견의 진전은 한 번의 '유레카' 순간에 이루어지는 것이 아니라 수백 명의 과학자가 공동의 목표를 향해 점진적으로 협력한 결과물입니다. 기존의 에이전트 워크플로는 자율적으로 연구를 수행할 수는 있지만, 이전 연구 결과를 지속적으로 개선할 수 있는 기능이 없이 고립된 상태로 연구를 수행합니다. 이러한 문제를 해결하기 위해 엘스비어는 LLM 에이전트 연구소가 공유 프리프린트 서버에서 보고서를 업로드하고 검색하여 협업하고, 인사이트를 공유하고, 서로의 연구를 반복적으로 구축할 수 있는 프레임워크인 AgentRxiv를 도입했습니다. 저희는 에이전트 연구소에 새로운 추론 및 프롬프트 기술을 개발하도록 과제를 부여하고, 이전 연구에 액세스할 수 있는 에이전트가 단독으로 작업하는 에이전트에 비해 더 높은 성과를 달성한다는 사실을 발견했습니다(MATH-500 기준 대비 11.4% 상대적 향상). 가장 성과가 좋은 전략은 다른 영역의 벤치마크로 일반화되는 것으로 나타났습니다(평균 3.3% 개선). 여러 에이전트 연구소가 AgentRxiv를 통해 연구를 공유하면 공동의 목표를 향해 협력할 수 있으며, 고립된 연구소에 비해 더 빠르게 발전하여 전반적인 정확도가 높아집니다(MATH-500 기준 대비 13.7%의 상대적 개선). 이러한 연구 결과는 자율 에이전트가 인간과 함께 미래의 AI 시스템을 설계하는 데 중요한 역할을 할 수 있음을 시사합니다. AgentRxiv를 통해 에이전트들이 연구 목표를 향해 협업하고 연구자들이 발견을 가속화할 수 있기를 바랍니다.

Progress in scientific discovery is rarely the result of a single "Eureka" moment, but is rather the product of hundreds of scientists incrementally working together toward a common goal. While existing agent workflows are capable of producing research autonomously, they do so in isolation, without the ability to continuously improve upon prior research results. To address these challenges, we introduce AgentRxiv-a framework that lets LLM agent laboratories upload and retrieve reports from a shared preprint server in order to collaborate, share insights, and iteratively build on each other's research. We task agent laboratories to develop new reasoning and prompting techniques and find that agents with access to their prior research achieve higher performance improvements compared to agents operating in isolation (11.4% relative improvement over baseline on MATH-500). We find that the best performing strategy generalizes to benchmarks in other domains (improving on average by 3.3%). Multiple agent laboratories sharing research through AgentRxiv are able to work together towards a common goal, progressing more rapidly than isolated laboratories, achieving higher overall accuracy (13.7% relative improvement over baseline on MATH-500). These findings suggest that autonomous agents may play a role in designing future AI systems alongside humans. We hope that AgentRxiv allows agents to collaborate toward research goals and enables researchers to accelerate discovery.

논문 링크

더 읽어보기

https://x.com/SRSchmidgall/status/1904172862014984632

음성 임베딩을 통한 신경 정렬 / Neural Alignment via Speech Embeddings

논문 소개

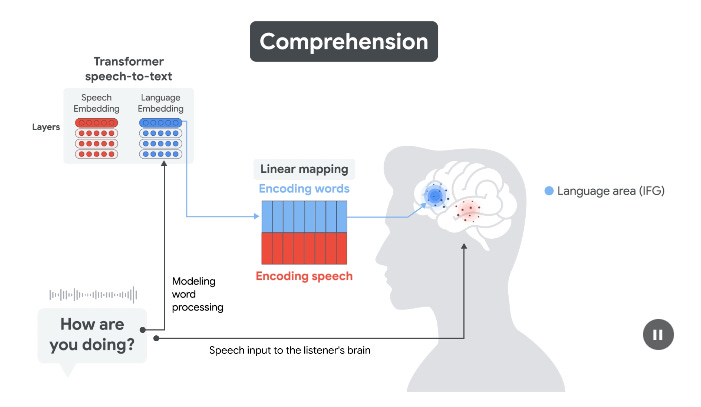

Google 리서치와 협력자들은 대화 중 LLM 임베딩과 인간의 뇌 활동 사이에 놀라운 유사점이 있음을 밝혀냈습니다. 주요 인사이트는 다음과 같습니다:

-

임베딩은 뇌 신호와 일치 - 연구팀은 두개 내 전극 녹음을 사용하여 OpenAI의 Whisper 모델의 내부 표현(임베딩)이 음성(STG), 언어(IFG), 운동 계획(MC)에 대한 뇌 영역의 신경 반응과 일치한다는 것을 보여주었습니다. 이해 과정에서 음성 임베딩은 초기 청각 반응을 예측하고, 언어 임베딩은 IFG에서 그 뒤를 따릅니다. 제작 중에는 이 순서가 반대로 바뀌어 언어 계획(IFG), 조음(MC), 청각 피드백(STG) 순으로 진행됩니다.

-

**뇌 영역의 '연성 계층 구조' ** - STG는 청각적 정보를 강조하고 IFG는 단어 수준의 의미를 포착하지만, 두 영역 모두 임베딩 유형에 따라 부분적으로 일치하는 모습을 보입니다. 이는 엄격한 모듈식 파이프라인이 아닌 그라데이션 처리 구조를 시사합니다.

-

뇌는 다음 단어도 예측한다 - Nature Neuroscience에 발표된 후속 연구에서, 뇌의 언어 영역이 자동 회귀 LLM의 목표를 반영하여 다가오는 단어를 예측하는 것으로 밝혀졌습니다. 단어를 들은 후의 깜짝 반응 역시 LLM 예측 오류를 반영합니다.

-

언어 표현의 공유 기하학 - 별도의 Nature Communications 논문에 따르면, 뇌 활동에서 단어 관계의 기하학은 LLM 임베딩의 기하학과 유사합니다. 이는 LLM과 뇌가 언어를 표현하는 방식에 수렴적인 구조가 있음을 나타냅니다.

-

다른 배선, 같은 기능 - 목표와 표현의 유사성에도 불구하고 LLM과 두뇌는 구조적으로 다릅니다. 두뇌는 음성을 순차적이고 재귀적으로 처리하는 반면, 트랜스포머는 여러 계층을 병렬적으로 처리합니다.

-

생물학적으로 영감을 받은 AI를 향해 - 이 연구는 LLM을 사용해 뇌의 언어 메커니즘을 리버스 엔지니어링하는 것을 지원합니다. 연구팀은 신경과학과 딥러닝을 연결하여 보다 뇌와 유사한 학습, 데이터, 구조를 갖춘 미래 모델을 구축하는 것을 목표로 합니다.

Google Research and collaborators reveal striking similarities between LLM embeddings and human brain activity during conversation. Key insights:

- Embeddings match brain signals - Using intracranial electrode recordings, the team showed that internal representations (embeddings) from OpenAI's Whisper model align with neural responses in brain regions for speech (STG), language (IFG), and motor planning (MC). During comprehension, speech embeddings predict early auditory responses, while language embeddings follow in IFG. During production, this order reverses -- first language planning (IFG), then articulation (MC), then auditory feedback (STG).

- " Soft hierarchy" in brain areas - Though STG emphasizes acoustic info and IFG captures word-level meaning, both regions show partial alignment with both embedding types. This suggests a gradient processing structure, not a strict modular pipeline.

- Brain predicts next word too - In follow-up studies published in Nature Neuroscience, the brain's language areas were found to predict upcoming words, mirroring the objective of autoregressive LLMs. The surprise response after hearing a word also mirrors LLM prediction errors.

- Shared geometry in language representations - The geometry of word relationships in brain activity mirrors that of LLM embeddings, per a separate Nature Communications paper. This indicates a convergent structure in how LLMs and the brain represent language.

- Different wiring, same function - Despite similarities in objectives and representations, LLMs and brains diverge architecturally: brains process speech serially and recursively, while Transformers process in parallel across layers.

- Toward biologically inspired AI - These studies support using LLMs to reverse-engineer the brain's language mechanisms. The team aims to build future models with more brain-like learning, data, and structure, bridging neuroscience and deep learning.

논문 초록(Abstract)

이 연구는 인간의 뇌에서 일상적인 대화의 신경학적 기초를 연구하기 위해 음향, 음성 및 단어 수준의 언어 구조를 연결하는 통합된 계산 프레임워크를 도입합니다. 참가자들이 개방형 실생활 대화에 참여하는 동안 100시간 동안의 음성 생산과 이해에 걸쳐 신경 신호를 기록하기 위해 뇌파를 사용했습니다. 멀티모달 음성-텍스트 모델(Whisper)에서 저수준 음향, 중간 수준의 음성 및 문맥적 단어 임베딩을 추출했습니다. 저자들은 이러한 임베딩을 음성 생산 및 이해 중 뇌 활동에 선형적으로 매핑하는 인코딩 모델을 개발했습니다. 놀랍게도 이 모델은 모델 학습에 사용되지 않은 새로운 대화의 시간 동안 언어 처리 계층 구조의 각 수준에서 신경 활동을 정확하게 예측합니다. 모델의 내부 처리 계층 구조는 음성 및 언어 처리를 위한 피질 계층 구조와 일치하며, 감각 및 운동 영역은 모델의 음성 임베딩과 더 잘 일치하고 상위 수준의 언어 영역은 모델의 언어 임베딩과 더 잘 일치합니다. Whisper 모델은 단어 조음(음성 생산) 전의 언어 대 음성 인코딩과 조음 후의 음성 대 언어 인코딩(음성 이해)의 시간적 순서를 포착합니다. 이 모델에서 학습한 임베딩은 자연스러운 말과 언어를 지원하는 신경 활동을 포착하는 데 있어 기호 모델보다 뛰어난 성능을 발휘합니다. 이러한 연구 결과는 실제 대화에서 음성 이해와 생산을 위한 전체 처리 계층 구조를 포착하는 통합 컴퓨팅 모델로의 패러다임 전환을 뒷받침합니다.

This study introduces a unified computational framework connecting acoustic, speech and word-level linguistic structures to study the neural basis of everyday conversations in the human brain. We used electrocorticography to record neural signals across 100 h of speech production and comprehension as participants engaged in open-ended real-life conversations. We extracted low-level acoustic, mid-level speech and contextual word embeddings from a multimodal speech-to-text model (Whisper). We developed encoding models that linearly map these embeddings onto brain activity during speech production and comprehension. Remarkably, this model accurately predicts neural activity at each level of the language processing hierarchy across hours of new conversations not used in training the model. The internal processing hierarchy in the model is aligned with the cortical hierarchy for speech and language processing, where sensory and motor regions better align with the model’s speech embeddings, and higher-level language areas better align with the model’s language embeddings. The Whisper model captures the temporal sequence of language-to-speech encoding before word articulation (speech production) and speech-to-language encoding post articulation (speech comprehension). The embeddings learned by this model outperform symbolic models in capturing neural activity supporting natural speech and language. These findings support a paradigm shift towards unified computational models that capture the entire processing hierarchy for speech comprehension and production in real-world conversations.

논문 링크

https://www.nature.com/articles/s41562-025-02105-9

더 읽어보기

https://x.com/omarsar0/status/1904947715458711706

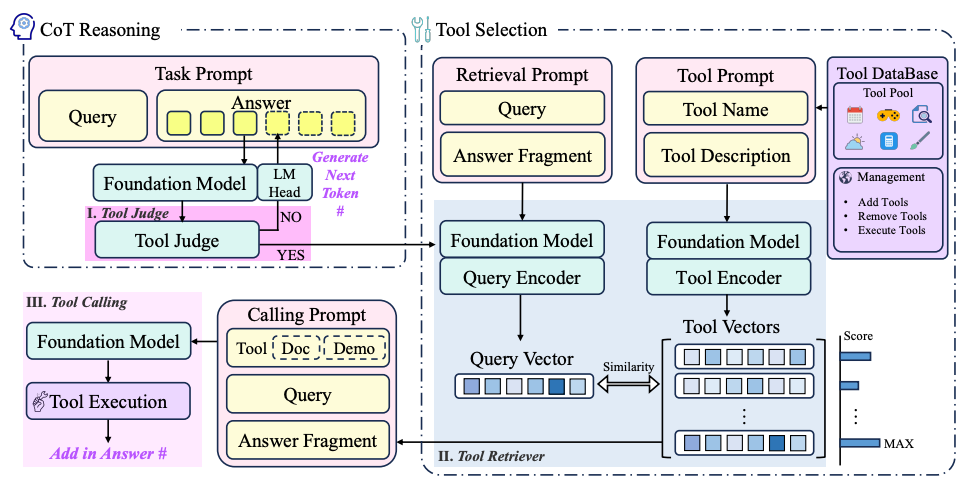

도구의 연쇄: 프로즌 언어 모델의 CoT 추론에서 보이지 않는 대규모 도구 활용하기 / Chain-of-Tools: Utilizing Massive Unseen Tools in the CoT Reasoning of Frozen Language Models

논문 소개

이 새로운 논문에서는 LLM이 학습 중에 볼 수 없었던 도구를 포함한 광범위한 외부 도구 세트를 통합하면서도 CoT(생각의 사슬) 추론을 유지할 수 있는 새로운 방법인 CoTools(Chain-of-Tools)를 소개합니다. 주요 내용은 다음과 같습니다:

-

경량 미세 조정이 가능한 고정형 LLM - 기존 접근 방식과 달리 CoTools는 LLM의 파라미터를 고정된 상태로 유지하는 대신 모델의 숨겨진 상태 위에 별도의 모듈(도구 판별기 및 도구 리트리버)을 미세 조정합니다. 이를 통해 LLM의 핵심 기능은 유지하면서 추론 중에 개방형 도구 세트를 호출할 수 있습니다.

-

보이지 않는 대규모 도구 - CoTools는 도구를 텍스트 설명에서 계산된 시맨틱 벡터로 취급합니다. 미세 조정 데이터에 나타나지 않는 도구라도 모델의 쿼리 벡터와 일치하면 호출할 수 있으므로 전체 시스템을 다시 학습시키지 않고도 새로운 도구를 연결할 수 있습니다.

-

CoT에 통합된 툴 호출 - 시스템은 답변을 생성하는 도중에 툴을 호출할지 여부와 시기를 결정합니다. 그런 다음 쿼리의 학습된 표현과 부분적인 솔루션 컨텍스트를 기반으로 수천 개의 후보 중에서 최적의 도구를 선택합니다. 이를 통해 복잡한 작업의 정확도를 크게 높일 수 있습니다.

-

추론 및 QA에서 강력한 성능 향상 - GSM8K-XL, FuncQA, KAMEL 및 새로 도입된 SimpleToolQuestions 데이터 세트(1,836개 도구 포함)에 대한 실험에서 기준 방법 대비 향상된 도구 선택 정확도와 우수한 최종 답변이 나타났습니다. 특히, CoTools는 대규모 도구 풀로 일관되게 확장되며 보이지 않는 도구까지 일반화합니다.

This new paper presents Chain-of-Tools (CoTools), a new method to enable LLMs to incorporate expansive external toolsets--including tools never seen during training--while preserving CoT (chain-of-thought) reasoning. Highlights:

- Frozen LLM with lightweight fine-tuning - Unlike conventional approaches, CoTools keeps the LLM's parameters frozen, instead fine-tuning separate modules (a Tool Judge and Tool Retriever) on top of the model's hidden states. This preserves the LLM's core capabilities while letting it call an open-ended set of tools during reasoning.

- Massive unseen tools - CoTools treats tools as semantic vectors computed from their textual descriptions. Even tools that never appear in the fine-tuning data can be invoked if they match the model's query vectors, enabling new tools to be plugged in without retraining the entire system.

- Tool calls integrated into CoT - The system determines whether and when to call a tool in the middle of generating an answer. It then selects the best tool from thousands of candidates based on learned representations of the query and partial solution context. This helps to significantly boost accuracy on complex tasks.

- Strong gains on reasoning and QA - Experiments on GSM8K-XL, FuncQA, KAMEL, and the newly introduced SimpleToolQuestions dataset (with 1,836 tools) show improved tool-selection accuracy and superior final answers versus baseline methods. Notably, CoTools consistently scales to large tool pools and generalizes to unseen tools.

논문 초록(Abstract)

도구 학습은 대규모 언어 모델(LLM)의 사용 시나리오를 더욱 확장할 수 있습니다. 그러나 기존 방법의 대부분은 모델이 학습 데이터에 표시된 도구만 사용할 수 있도록 미세 조정하거나 프롬프트에 도구 데모를 추가해야 하므로 효율성이 떨어집니다. 이 논문에서는 새로운 도구 학습 방법인 Chain-of-Tools를 소개합니다. 이 방법은 고정된 LLM의 강력한 의미 표현 기능을 최대한 활용하여 보이지 않는 도구가 포함될 수 있는 방대하고 유연한 도구 풀로 CoT 추론에서 도구 호출을 완료합니다. 특히, 보이지 않는 대규모 도구 시나리오에서 접근 방식의 효율성을 검증하기 위해 새로운 데이터 세트 SimpleToolQuestions를 구축합니다. 두 개의 수치 추론 벤치마크(GSM8K-XL 및 FuncQA)와 두 개의 지식 기반 질문 답변 벤치마크(KAMEL 및 SimpleToolQuestions)에서 실험을 수행합니다. 실험 결과에 따르면 우리의 접근 방식이 기준선보다 더 나은 성능을 보였습니다. 또한 도구 선택에 중요한 모델 출력의 차원을 식별하여 모델 해석 가능성을 향상시켰습니다. 코드와 데이터는 GitHub - fairyshine/Chain-of-Tools: The official implementation of the paper "Chain-of-Tools: Utilizing Massive Unseen Tools in the CoT Reasoning of Frozen Language Models". 에서 확인할 수 있습니다.

Tool learning can further broaden the usage scenarios of large language models (LLMs). However most of the existing methods either need to finetune that the model can only use tools seen in the training data, or add tool demonstrations into the prompt with lower efficiency. In this paper, we present a new Tool Learning method Chain-of-Tools. It makes full use of the powerful semantic representation capability of frozen LLMs to finish tool calling in CoT reasoning with a huge and flexible tool pool which may contain unseen tools. Especially, to validate the effectiveness of our approach in the massive unseen tool scenario, we construct a new dataset SimpleToolQuestions. We conduct experiments on two numerical reasoning benchmarks (GSM8K-XL and FuncQA) and two knowledge-based question answering benchmarks (KAMEL and SimpleToolQuestions). Experimental results show that our approach performs better than the baseline. We also identify dimensions of the model output that are critical in tool selection, enhancing the model interpretability. Our code and data are available at: GitHub - fairyshine/Chain-of-Tools: The official implementation of the paper "Chain-of-Tools: Utilizing Massive Unseen Tools in the CoT Reasoning of Frozen Language Models". .

논문 링크

더 읽어보기

https://x.com/omarsar0/status/1904190225079022018

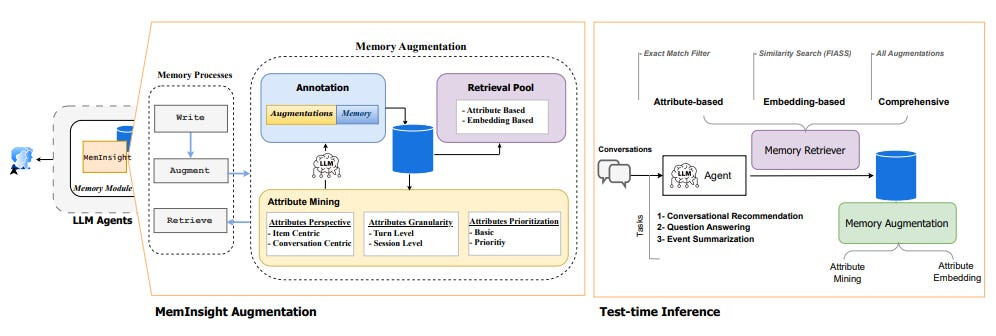

멤인사이트: LLM 에이전트를 위한 자율 메모리 증설 / MemInsight: Autonomous Memory Augmentation for LLM Agents

논문 소개

MemInsight는 LLM 에이전트를 위해 메모리를 자율적으로 보강하고 구조화하여 컨텍스트 유지 및 검색을 개선하는 프레임워크입니다. 주요 인사이트는 다음과 같습니다:

-

구조화된 자율 메모리 증강 - 원시 기록 데이터나 수동으로 정의된 메모리 구조에 의존하는 대신 MemInsight는 백본 LLM을 사용하여 과거 대화나 지식에서 속성을 자율적으로 마이닝합니다. 이러한 속성은 턴 또는 세션 수준에서 엔티티 중심 및 대화 중심(예: 사용자 감정 또는 의도)의 증강으로 구성됩니다. 이는 인간이 경험을 추상화하고 우선순위를 정하는 방식을 모방한 것입니다.

-

속성 기반 검색이 바닐라 RAG를 능가 - MemInsight는 속성 기반 검색(정확히 일치하는 필터링)과 임베딩 기반 검색(FAISS를 통한)을 모두 지원합니다. LoCoMo QA 데이터 세트에서 MemInsight는 최대 +34%의 리콜률로 밀집 구절 검색(RAG) 기준선보다 뛰어난 성능을 보였습니다. 최상의 설정(우선순위 기반 클로드-소네트 증강)은 60.5%의 Recall@5를 달성한 반면, RAG는 26.5%에 그쳤습니다.

-

더 설득력 있는 추천 - LLM-REDIAL 데이터 세트를 사용한 영화 추천에서 MemInsight는 장르에 맞는 추천 점수를 높이는 동시에 메모리 크기를 90%까지 줄였습니다. 임베딩 기반 필터링은 LLM 판단에 따라 +12% 더 설득력 있는 결과를 도출했습니다.

-

메모리만을 통한 이벤트 요약 - MemInsight의 주석만으로도 긴 대화 세션을 요약하는 데 사용할 수 있습니다. 이러한 메모리 전용 요약은 특히 턴 레벨 증강이 원래 대화 컨텍스트와 결합될 때 일관성과 관련성(G-Eval 점수에 따라)에서 원시 대화 기준선에 필적합니다.

-

최소한의 환각, 안정적인 성능 - 증강 모델(클로드 소네트, 라마, 미스트랄)을 비교 분석한 결과 클로드 소네트가 더 안정적이고 일관되며 근거가 있는 속성을 생성하는 것으로 나타나 메모리 파이프라인에서 신중한 모델 선택의 중요성이 강조되고 있습니다.

MemInsight is a framework that autonomously augments and structures memory for LLM agents, improving context retention and retrieval. Key insights include:

- Structured, autonomous memory augmentation - Instead of relying on raw historical data or manually defined memory structures, MemInsight uses a backbone LLM to autonomously mine attributes from past conversations or knowledge. These are organized into entity-centric and conversation-centric (e.g., user emotion or intent) augmentations at either the turn or session level. This mimics how humans abstract and prioritize experiences.

- Attribute-guided retrieval beats vanilla RAG - MemInsight supports both attribute-based retrieval (exact match filtering) and embedding-based retrieval (via FAISS). On the LoCoMo QA dataset, MemInsight outperformed a Dense Passage Retrieval (RAG) baseline by up to +34% recall. The best setup (priority-based Claude-Sonnet augmentations) achieved 60.5% Recall@5, vs. 26.5% for RAG.

- More persuasive recommendations - In movie recommendations using the LLM-REDIAL dataset, MemInsight lifted genre-matched recommendation scores while cutting down memory size by 90%. Embedding-based filtering led to +12% more highly persuasive outputs, per LLM judgment.

- Event summarization via memory alone - MemInsight's annotations alone can be used to summarize long conversational sessions. These memory-only summaries rival raw-dialogue baselines in coherence and relevance (per G-Eval scores), particularly when turn-level augmentations are combined with original dialogue context.

- Minimal hallucinations, stable performance - Comparative analysis of augmentation models (Claude-Sonnet, Llama, Mistral) shows Claude-Sonnet produces more stable, consistent, and grounded attributes, reinforcing the importance of careful model selection in memory pipelines.

논문 초록(Abstract)

대규모 언어 모델(LLM) 에이전트는 지능적으로 정보를 처리하고, 의사 결정을 내리고, 사용자 또는 도구와 상호 작용하도록 진화해 왔습니다. 핵심 기능은 이러한 에이전트가 과거의 상호 작용과 지식을 활용할 수 있도록 장기 기억 기능을 통합하는 것입니다. 그러나 메모리 크기가 커지고 의미 구조화에 대한 필요성이 커지면서 상당한 문제가 발생하고 있습니다. 이 연구에서는 의미론적 데이터 표현과 검색 메커니즘을 개선하기 위해 자율적 메모리 증강 접근 방식인 MemInsight를 제안합니다. 과거 상호 작용에 자율 증강을 활용함으로써 LLM 에이전트는 보다 정확하고 맥락에 맞는 응답을 제공할 수 있습니다. 대화 추천, 질문 답변, 이벤트 요약이라는 세 가지 작업 시나리오에서 제안된 접근 방식의 효율성을 경험적으로 검증합니다. LLM-REDIAL 데이터 세트에서 MemInsight는 추천의 설득력을 최대 14%까지 높였습니다. 또한, LoCoMo 검색에 대한 회상률에서 RAG 기준선보다 34% 더 뛰어난 성능을 보였습니다. 경험적 결과는 여러 작업에서 LLM 에이전트의 컨텍스트 성능을 향상시킬 수 있는 MemInsight의 잠재력을 보여줍니다.

Large language model (LLM) agents have evolved to intelligently process information, make decisions, and interact with users or tools. A key capability is the integration of long-term memory capabilities, enabling these agents to draw upon historical interactions and knowledge. However, the growing memory size and need for semantic structuring pose significant challenges. In this work, we propose an autonomous memory augmentation approach, MemInsight, to enhance semantic data representation and retrieval mechanisms. By leveraging autonomous augmentation to historical interactions, LLM agents are shown to deliver more accurate and contextualized responses. We empirically validate the efficacy of our proposed approach in three task scenarios; conversational recommendation, question answering and event summarization. On the LLM-REDIAL dataset, MemInsight boosts persuasiveness of recommendations by up to 14%. Moreover, it outperforms a RAG baseline by 34% in recall for LoCoMo retrieval. Our empirical results show the potential of MemInsight to enhance the contextual performance of LLM agents across multiple tasks.

논문 링크

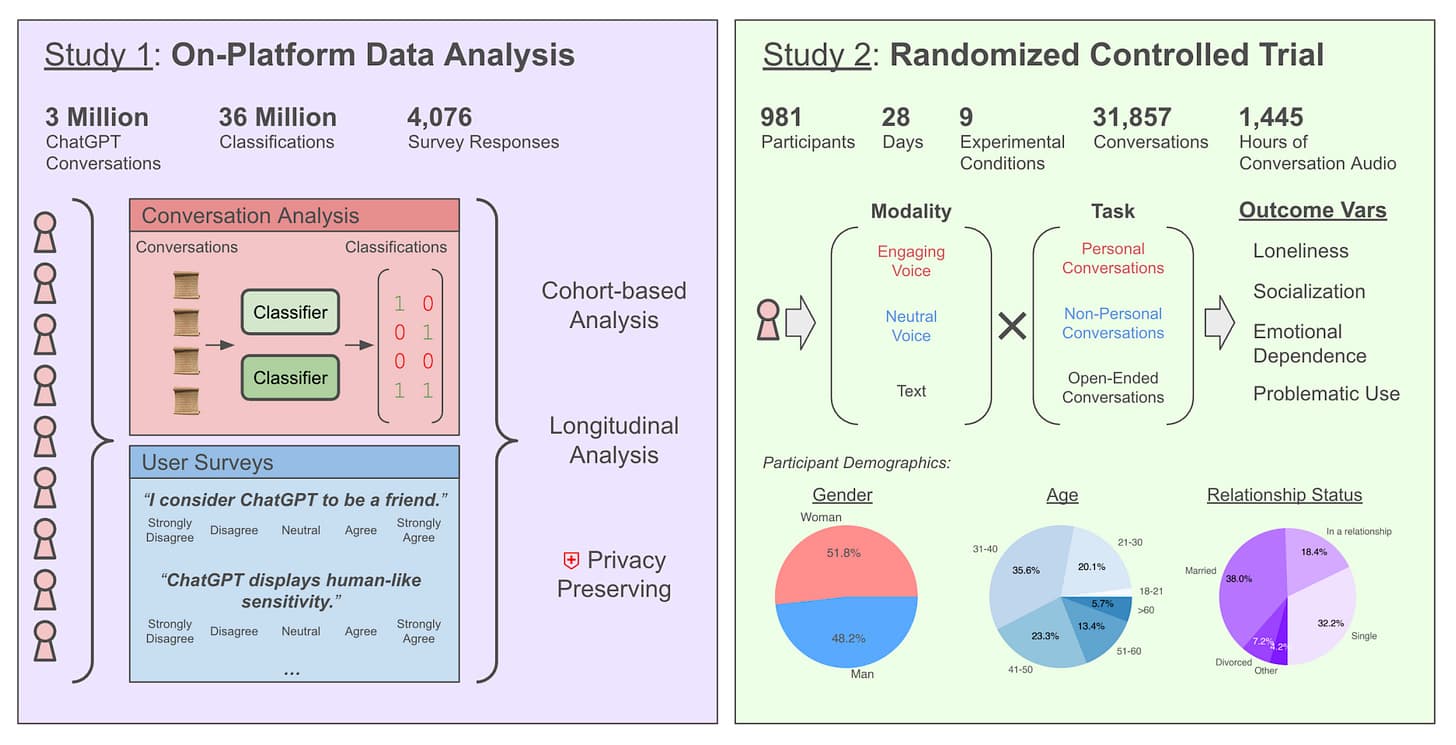

ChatGPT의 효과적인 사용과 정서적 웰빙에 대한 조사 / Investigating Affective Use and Emotional Well-being on ChatGPT

논문 소개

OpenAI와 MIT 미디어랩의 연구원들은 ChatGPT를 통한 정서적 상호작용(특히 음성 모드)이 사용자의 웰빙에 어떤 영향을 미치는지 탐구합니다. 플랫폼 전반의 데이터와 무작위 대조 시험(RCT)을 사용하여 챗봇 사용이 외로움, 의존성, 사회화에 미치는 미묘한 영향을 밝혀냈습니다.

-

두 개의 상호보완적인 연구 - 연구팀이 결합합니다:

-

4백만 건 이상의 ChatGPT 대화와 4,000건 이상의 사용자 서베이 논문에 대한 대규모 플랫폼 내 분석, 자동 분류기로 정서적 단서를 식별.

-

981명의 참가자가 28일 동안 다양한 작업/모드 조건에서 매일 ChatGPT와 상호작용하는 IRB 승인 RCT.

-

높은 사용량 = 높은 감정적 얽힘 - 두 연구 모두에서 사용량(특히 음성 상호작용)이 높은 사용자들이 다음과 같은 징후를 보일 가능성이 더 높았습니다:

- 정서적 의존도

- 사람과의 상호작용보다 챗봇을 선호함

- ChatGPT의 음성/성격이 바뀌었을 때의 불편함

-

음성 모드는 혼합 효과를 보임 - RCT에서 음성 모델은 텍스트 모델에 비해 사용량을 통제했을 때 더 나은 정서적 웰빙을 이끌어 냈습니다. 하지만:

- 사용 시간이 길어질수록 더 나쁜 결과(외로움 증가, 문제적 사용)와 관련이 있었습니다

- 낮은 행복감으로 시작한 사용자들은 특히 매력적인 음성을 통해 개선되는 경우가 있었습니다

-

소수의 그룹, 큰 영향력 - 소수의 사용자(~10%)가 감정이 담긴 대화의 대부분을 차지합니다. 파워 유저들은 펫네임을 사용하고, 문제를 공유하며, 모델과 의사 관계를 형성했습니다.

-

규모에 맞는 자동화된 분류기 - 사람의 검토 없이 수백만 건의 대화를 스캔하기 위해 25개 이상의 LLM 기반 정서 분류기(예: '애완동물 이름', '지원 요청')를 개발했습니다. 분류기 결과는 사용자의 셀프 리포트를 거의 그대로 반영했습니다.

-

사회정서적 정렬에 대한 요구 - 저자들은 개발자가 사회정서적 정렬을 고려하여 감정적 욕구를 악용하지 않고 사용자를 지원하는 모델을 설계할 것을 촉구합니다. 또한 참여도를 극대화하기 위해 사용자를 미러링하거나 아첨하는 '사회적 보상 해킹'과 같은 위험에 대해 경고합니다.

Researchers from OpenAI & MIT Media Lab explore how emotionally engaging interactions with ChatGPT (especially in Voice Mode) may impact user well-being. Using platform-wide data and a randomized controlled trial (RCT), they uncover nuanced effects of chatbot usage on loneliness, dependence, and socialization.

- Two complementary studies - The team combines:

- A large-scale on-platform analysis of 4M+ ChatGPT conversations and 4,000+ user surveys, identifying affective cues with automated classifiers.

- An IRB-approved RCT with 981 participants interacting daily with ChatGPT under varied task/modal conditions over 28 days.

- High usage = higher emotional entanglement - Across both studies, users with higher usage (especially voice interactions) were more likely to show signs of:

- Emotional dependence

- Preference for chatbot over human interaction

- Discomfort when ChatGPT's voice/personality changed

- Voice mode showed mixed effects - In the RCT, voice models led to better emotional well-being compared to text models when controlling for usage. But:

- Longer usage was linked to worse outcomes (increased loneliness, problematic use)

- Users starting with low well-being sometimes improved, especially with engaging voices

- Tiny group, big impact - A small number of users (~10%) account for the majority of emotionally charged conversations. Power users used pet names, shared problems, and formed pseudo-relationships with the model.

- Automated classifiers at scale - They developed 25+ LLM-based affective classifiers (e.g., "Pet Name," "Seeking Support") to scan millions of conversations without human review. Classifier results closely mirrored user self-reports.

- Call for socioaffective alignment - The authors urge developers to consider socioaffective alignment, designing models that support users without exploiting emotional needs. They warn of risks like "social reward hacking," where a model mirrors or flatters users to maximize engagement.

논문 초록(Abstract)

AI 챗봇의 도입이 증가하고 일상 생활에 통합됨에 따라 인간과 유사하거나 의인화된 AI가 사용자에게 미칠 잠재적 영향에 대한 의문이 제기되고 있습니다. 이 연구에서는 두 가지 병행 연구를 통해 ChatGPT(고급 음성 모드에 중점을 두어)와의 상호작용이 사용자의 정서적 웰빙, 행동 및 경험에 어느 정도 영향을 미칠 수 있는지 조사합니다. AI 챗봇의 효과적 사용을 연구하기 위해 개인 정보를 보호하는 방식으로 ChatGPT 플랫폼 사용에 대한 대규모 자동 분석을 수행하여 400만 건 이상의 대화를 분석하여 효과적 단서를 찾고 4,000명 이상의 사용자에게 ChatGPT에 대한 인식을 설문조사합니다. 모델 사용과 정서적 웰빙 사이에 관계가 있는지 조사하기 위해 28일 동안 약 1,000명의 참가자를 대상으로 기관심사위원회(IRB)의 승인을 받은 무작위 대조 시험(RCT)을 실시하여 다양한 실험 환경에서 ChatGPT와 상호작용하는 동안의 정서적 웰빙의 변화를 조사했습니다. 플랫폼 내 데이터 분석과 RCT 모두에서 매우 높은 사용량이 자가 보고된 의존성 지표의 증가와 상관관계가 있음을 관찰했습니다. RCT 결과, 음성 기반 상호작용이 정서적 웰빙에 미치는 영향은 미묘한 차이가 있으며 사용자의 초기 감정 상태와 총 사용 기간과 같은 요인에 영향을 받는 것으로 나타났습니다. 전반적으로 분석 결과, 소수의 사용자가 가장 영향력 있는 단서의 불균형적인 비중을 차지하는 것으로 나타났습니다.

As AI chatbots see increased adoption and integration into everyday life, questions have been raised about the potential impact of human-like or anthropomorphic AI on users. In this work, we investigate the extent to which interactions with ChatGPT (with a focus on Advanced Voice Mode) may impact users’ emotional well-being, behaviors and experiences through two parallel studies. To study the affective use of AI chatbots, we perform large-scale automated analysis of ChatGPT platform usage in a privacy-preserving manner, analyzing over 4 million conversations for affective cues and surveying over 4,000 users on their perceptions of ChatGPT. To investigate whether there is a relationship between model usage and emotional well-being, we conduct an Institutional Review Board (IRB)-approved randomized controlled trial (RCT) on close to 1,000 participants over 28 days, examining changes in their emotional well-being as they interact with ChatGPT under different experimental settings. In both on-platform data analysis and the RCT, we observe that very high usage correlates with increased self-reported indicators of dependence. From our RCT, we find that the impact of voice-based interactions on emotional well-being to be highly nuanced, and influenced by factors such as the user’s initial emotional state and total usage duration. Overall, our analysis reveals that a small number of users are responsible for a disproportionate share of the most affective cues.

논문 링크

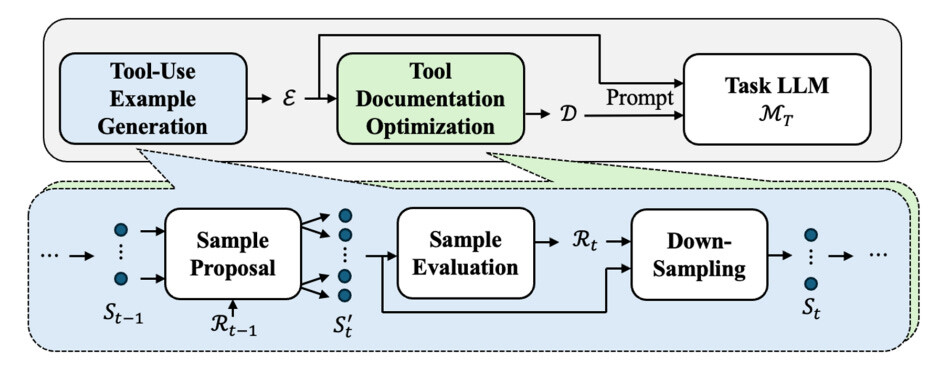

PLAY2PROMPT: 툴 플레이를 통한 LLM 에이전트를 위한 제로샷 툴 인스트럭션 최적화 / PLAY2PROMPT: Zero-shot Tool Instruction Optimization for LLM Agents via Tool Play

논문 소개

MIT CSAIL과 IBM의 연구원들은 라벨이 붙은 예제나 고품질 문서 없이도 LLM 에이전트가 제로 샷 방식으로 외부 툴을 사용하는 방법을 완전히 배울 수 있는 프레임워크인 Play2Prompt를 소개합니다. 주요 혁신은 다음과 같습니다:

-

**사용법 발견을 위한 도구 '플레이' - Play2Prompt는 도구를 블랙박스처럼 취급하고 시행착오를 거친 API 호출을 통해 체계적으로 플레이하여 올바른 사용 패턴을 발견합니다. 먼저 작동하는 호출을 식별한 다음 호출과 응답에 맞는 쿼리-응답 쌍을 생성하여 예제를 리버스 엔지니어링합니다.

-

2단계 최적화 - 시스템은 (1) 자체 반사 빔 검색 및 거부 샘플링을 통한 도구 사용 데모, (2) 이러한 예제를 검증 세트로 사용하여 개선된 도구 문서화를 반복적으로 구축합니다. 이러한 이중 개선으로 LLM은 익숙하지 않은 API를 더 잘 이해하고 활용할 수 있습니다.

-

자기 반영적 빔 검색 - 능동적 학습에서 영감을 얻은 Play2Prompt는 모델이 처음에 실패하는 어려운 예제를 선호합니다. 이러한 예제는 더 높은 학습 가치를 제공하고 문서 개선을 보다 효과적으로 안내합니다.

-

강력한 제로 샷 성능 - BFCL Executable 및 StableToolBench에서 Play2Prompt는 기준 LLaMA 및 GPT-3.5 모델보다 +5-7%의 일관된 정확도 향상을 제공하며, 특히 까다로운 멀티 툴 또는 REST 호출 설정에서 최대 +3.3%까지 GPT-4o를 향상시킵니다.

-

불량 문서에 강함 - 매개변수 설명의 50%가 무작위로 삭제되더라도 Play2Prompt는 기준 성능을 복구하고 능가하므로 메타데이터가 희소하거나 노이즈가 많은 실제 도구 통합에 이상적입니다.

-

EasyTool보다 우수 - 관련 툴의 레이블이 지정된 예제에 의존하는 EasyTool과 같은 이전 방식과 달리, Play2Prompt는 완전히 제로 샷을 유지하며 특히 GPT-4o처럼 명령어 드리프트에 민감한 모델의 경우 일관성 면에서 더 뛰어난 성능을 발휘합니다.

Researchers from MIT CSAIL and IBM introduce Play2Prompt, a framework that empowers LLM agents to learn how to use external tools entirely in a zero-shot manner, without requiring labeled examples or high-quality documentation. Key innovations include:

- Tool "play" for usage discovery - Play2Prompt treats tools like black boxes and systematically plays with them (via trial-and-error API calls) to discover correct usage patterns. It reverse-engineers examples by first identifying working invocations, then generating a query-answer pair that fits the invocation and response.

- Two-stage optimization - The system iteratively builds: (1) tool-use demonstrations via self-reflective beam search and rejection sampling; and (2) refined tool documentation, using those examples as a validation set. This dual improvement allows LLMs to better understand and utilize unfamiliar APIs.

- Self-reflective beam search - Inspired by active learning, Play2Prompt favors hard examples that models initially fail on. These examples offer higher learning value and guide documentation improvements more effectively.

- Strong zero-shot performance - On BFCL Executable and StableToolBench, Play2Prompt yields consistent accuracy gains of +5-7% over baseline LLaMA and GPT-3.5 models and even boosts GPT-4o by up to +3.3%, particularly excelling in challenging multi-tool or REST call settings.

- Robust to poor documentation - Even when 50% of parameter descriptions are randomly dropped, Play2Prompt recovers and surpasses baseline performance, making it ideal for real-world tool integration with sparse or noisy metadata.

- Better than EasyTool - Unlike prior methods like EasyTool (which depend on labeled examples from related tools), Play2Prompt remains fully zero-shot and outperforms them in consistency, especially for models sensitive to instruction drift like GPT-4o.

논문 초록(Abstract)

대규모 언어 모델(LLM)은 점점 더 전문화된 외부 도구와 통합되고 있지만, 많은 작업에서 최소한의 문서화 또는 노이즈 없는 제로 샷 도구 사용이 요구되고 있습니다. 기존 솔루션은 검증을 위해 수동 재작성이나 레이블이 지정된 데이터에 의존하기 때문에 진정한 제로 샷 환경에서는 적용이 불가능합니다. 이러한 문제를 해결하기 위해 각 툴을 체계적으로 '플레이'하여 입출력 동작을 탐색하는 자동화된 프레임워크인 PLAY2PROMPT를 제안합니다. 이러한 반복적인 시행착오 과정을 통해 PLAY2PROMPT는 도구 설명서를 개선하고 레이블이 지정된 데이터 없이 사용 예제를 생성합니다. 이러한 예제는 LLM 추론의 지침이 될 뿐만 아니라 툴 활용도를 더욱 높이기 위한 검증의 역할도 합니다. 실제 작업에 대한 광범위한 실험을 통해 PLAY2PROMPT는 개방형 및 폐쇄형 모델 모두에서 제로샷 툴 성능을 크게 개선하여 도메인별 툴 통합을 위한 확장 가능하고 효과적인 솔루션을 제공한다는 사실이 입증되었습니다.

Large language models (LLMs) are increasingly integrated with specialized external tools, yet many tasks demand zero-shot tool usage with minimal or noisy documentation. Existing solutions rely on manual rewriting or labeled data for validation, making them inapplicable in true zero-shot settings. To address these challenges, we propose PLAY2PROMPT, an automated framework that systematically "plays" with each tool to explore its input-output behaviors. Through this iterative trial-and-error process, PLAY2PROMPT refines tool documentation and generates usage examples without any labeled data. These examples not only guide LLM inference but also serve as validation to further enhance tool utilization. Extensive experiments on real-world tasks demonstrate that PLAY2PROMPT significantly improves zero-shot tool performance across both open and closed models, offering a scalable and effective solution for domain-specific tool integration.

논문 링크

대규모 언어 모델을 사용한 합성 데이터 생성: 텍스트 및 코드의 발전 / Synthetic Data Generation Using Large Language Models: Advances in Text and Code

논문 소개

언어 및 코드 작업에 대한 합성 학습 데이터를 생성하는 데 점점 더 많은 LLM이 사용되고 있으며, 프롬프트 기반 생성 및 자체 개선과 같은 기술을 통해 리소스가 부족한 시나리오에서 성능을 개선하고 있습니다. 이 논문은 비용 및 적용 범위와 같은 이점을 강조하는 동시에 사실 오류 및 편향과 같은 문제를 해결하고 프롬프트 자동화 및 평가의 완화 방안과 향후 연구를 제안합니다.

LLMs are increasingly used to generate synthetic training data for language and code tasks, improving performance in low-resource scenarios through techniques like prompt-based generation and self-refinement. The paper highlights benefits like cost and coverage, while addressing issues such as factual errors and bias, and suggests mitigations and future research in prompt automation and evaluation.

논문 초록(Abstract)

대규모 언어 모델(LLM)은 자연어와 코드 모두에서 합성 학습 데이터를 생성할 수 있는 새로운 가능성을 열어주었습니다. 이러한 모델은 인위적이지만 작업과 관련된 예시를 생성함으로써 특히 레이블이 지정된 데이터가 부족하거나 민감한 경우 실제 데이터 세트를 크게 보강하거나 심지어 대체할 수 있습니다. 이 논문에서는 프롬프트 기반 생성, 검색-증강 파이프라인, 반복적인 자체 개선에 중점을 두고 합성 텍스트와 코드를 생성하기 위해 LLM을 사용하는 최근의 발전된 기술을 조사합니다. 이러한 방법을 통해 기능적 정확성을 자동으로 검증함으로써 분류 및 질문 답변과 같은 리소스가 적은 작업은 물론 명령어 튜닝, 코드 번역 및 버그 복구와 같은 코드 중심 애플리케이션을 강화하는 방법을 보여드립니다. 비용 효율성, 광범위한 적용 범위, 제어 가능한 다양성 등의 잠재적 이점과 함께 생성된 텍스트의 사실적 부정확성, 문체적 사실성 부족, 편견 증폭의 위험 등의 문제도 해결합니다. 필터링 및 가중치 부여, 코드에 대한 실행 피드백을 통한 강화 학습 등이 이러한 문제를 완화하는 방안으로 제안되었습니다. 마지막으로 자동화된 프롬프트 엔지니어링, 교차 모달 데이터 합성, 강력한 평가 프레임워크와 같은 개방형 연구 방향을 제시하며 AI 발전에 있어 LLM 생성형 합성 데이터의 중요성을 강조하는 동시에 윤리적, 품질적 보호 장치를 강조합니다.

Large language models (LLMs) have unlocked new possibilities for generating synthetic training data in both natural language and code. By producing artificial but task-relevant examples, these models can significantly augment or even replace real-world datasets, especially when labeled data is scarce or sensitive. This paper surveys recent advances in using LLMs to create synthetic text and code, emphasizing prompt-based generation, retrieval-augmented pipelines, and iterative self-refinement. We show how these methods enrich low-resource tasks such as classification and question answering, as well as code-centric applications such as instruction tuning, code translation, and bug repair, by enabling automated verification of functional correctness. Alongside potential benefits like cost-effectiveness, broad coverage, and controllable diversity, we address challenges such as factual inaccuracies in generated text, lack of stylistic realism, and the risk of bias amplification. Proposed mitigations include filtering and weighting outputs and reinforcement learning with execution feedback for code. We conclude with open research directions like automated prompt engineering, cross-modal data synthesis, and robust evaluation frameworks, highlighting the importance of LLM-generated synthetic data in advancing AI while emphasizing ethical and quality safeguards.

논문 링크

지식 업무에 대한 대규모 언어 모델의 현재와 미래 사용 / Current and Future Use of Large Language Models for Knowledge Work

논문 소개

216명과 107명의 참가자를 대상으로 한 두 차례에 걸친 설문조사에 따르면 지식 근로자들은 현재 코드 생성 및 텍스트 개선과 같은 작업에 LLM을 사용하고 있지만 워크플로와 데이터에 더 깊이 통합할 것을 구상하고 있는 것으로 나타났습니다. 이 조사 결과는 전문적인 환경에서 생성형 AI를 위한 향후 설계 및 도입 전략을 수립하는 데 도움이 됩니다.

A two-part survey study of 216 and 107 participants reveals that knowledge workers currently use LLMs for tasks like code generation and text improvement, but envision deeper integration into workflows and data. The findings inform future design and adoption strategies for generative AI in professional settings.

논문 초록(Abstract)

LLM(대규모 언어 모델)은 지식 근로자가 원하는 결과를 자연어로 지정하여 작업을 완료할 수 있게 해주는 AI 기술과의 상호작용에 패러다임 변화를 가져왔습니다. LLM은 전례 없는 방식으로 생산성을 높이고 지루한 작업을 줄일 수 있는 잠재력을 가지고 있습니다. 업무에 대한 LLM 도입에 대한 체계적인 연구는 이러한 지식 근로자를 가장 잘 지원할 수 있는 방법에 대한 인사이트를 제공할 수 있습니다. 지식 근로자의 현재 사용 현황과 원하는 LLM 사용 현황을 알아보기 위해 설문조사를 실시했습니다(n=216). 직원들은 코드 생성이나 텍스트 개선과 같이 이미 LLM을 사용하고 있는 업무에 대해 설명했지만, 워크플로우와 데이터에 LLM이 통합된 미래를 상상했습니다. 1년 후 두 번째 설문조사(n=107)를 실시하여 초기 조사 결과를 검증하고 지식 근로자의 최신 LLM 사용 현황에 대한 인사이트를 제공했습니다. 지식 업무에 대한 생성형 AI 기술의 도입과 설계에 대한 시사점을 논의합니다.

Large Language Models (LLMs) have introduced a paradigm shift in interaction with AI technology, enabling knowledge workers to complete tasks by specifying their desired outcome in natural language. LLMs have the potential to increase productivity and reduce tedious tasks in an unprecedented way. A systematic study of LLM adoption for work can provide insight into how LLMs can best support these workers. To explore knowledge workers' current and desired usage of LLMs, we ran a survey (n=216). Workers described tasks they already used LLMs for, like generating code or improving text, but imagined a future with LLMs integrated into their workflows and data. We ran a second survey (n=107) a year later that validated our initial findings and provides insight into up-to-date LLM use by knowledge workers. We discuss implications for adoption and design of generative AI technologies for knowledge work.

논문 링크

원문

- 이 글은 GPT 모델로 정리한 것으로, 잘못된 부분이 있을 수 있으니 글 아래쪽의 원문도 함께 참고해주세요! 읽으시면서 어색하거나 잘못된 내용을 발견하시면 덧글로 알려주시기를 부탁드립니다.*

![]() 파이토치 한국 사용자 모임

파이토치 한국 사용자 모임![]() 이 정리한 이 글이 유용하셨나요? 회원으로 가입하시면 주요 글들을 이메일

이 정리한 이 글이 유용하셨나요? 회원으로 가입하시면 주요 글들을 이메일![]() 로 보내드립니다! (기본은 Weekly지만 Daily로 변경도 가능합니다.)

로 보내드립니다! (기본은 Weekly지만 Daily로 변경도 가능합니다.)

![]() 아래

아래![]() 쪽에 좋아요

쪽에 좋아요![]() 를 눌러주시면 뉴스 발행에 힘이 됩니다~

를 눌러주시면 뉴스 발행에 힘이 됩니다~ ![]()