Advanced RAG Cookbooks 소개

RAG란 무엇인가?

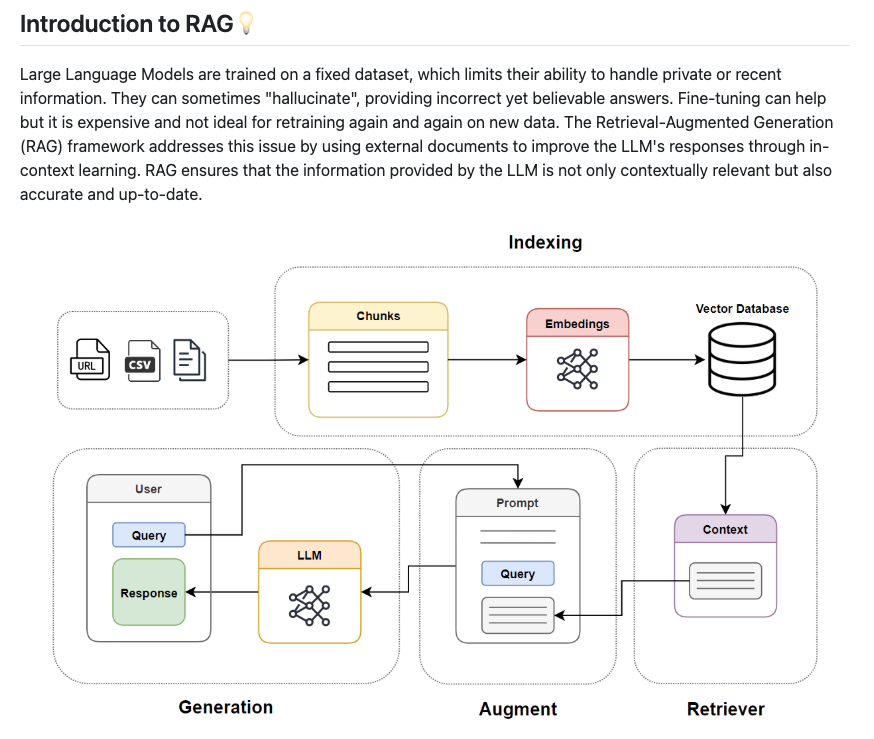

RAG(Retrieval-Augmented Generation)는 정보 검색과 텍스트 생성을 결합한 AI 기술로, 대형 언어 모델(LLM)의 한계를 보완하는 데 중요한 역할을 합니다. 기존 LLM은 고정된 데이터셋에 의존하여 훈련되기 때문에 최신 정보나 동적인 데이터를 처리하는 데 한계가 있습니다. 또한, "환각(hallucination)"으로 알려진 비현실적이거나 부정확한 정보를 제공할 가능성이 있습니다.

RAG는 외부 데이터를 검색하여 LLM의 응답 정확성을 향상시키는 프레임워크입니다. 사용자 요청에 적합한 문서를 검색한 후, 해당 문서를 바탕으로 더욱 정확한 응답을 생성합니다. 이를 통해 RAG는 LLM의 환각 문제를 해결하고, 최신 정보를 반영하며, 사용 사례에 적합한 맞춤형 결과를 제공합니다.

이 기술은 문서 요약, 대화형 AI, 정보 검색 등 다양한 응용 분야에서 활용될 수 있습니다. 특히 비용이 많이 드는 LLM의 파인튜닝(Fine-Tuning)을 대체할 수 있는 대안으로 주목받고 있습니다.

RAG의 구성 요소

RAG는 다음과 같은 4가지 주요 단계로 구성됩니다: 인덱싱(Indexing), 검색(Retriever), 증강(Augment), 생성(Generate)

-

인덱싱(Indexing): 문서 데이터베이스를 구축하는 단계입니다. 문서는 먼저 작은 청크(chunks)로 분리되며, 각각의 청크는 벡터화됩니다. 이러한 벡터는 검색 효율성을 높이기 위해 벡터 스토어(vector store)에 저장됩니다. 일반적으로 Pinecone, Chromadb, FAISS와 같은 벡터 스토어가 사용됩니다.

-

검색(Retriever): 사용자의 요청(query)에 가장 적합한 문서를 찾는 과정입니다. 검색자는 벡터 스토어에서 벡터 유사성 검색을 수행하며, 가장 관련성이 높은 문서 청크를 반환합니다. 검색 효율성과 정확도는 RAG의 성능에 큰 영향을 미칩니다.

-

증강(Augment): 검색된 문서를 바탕으로 사용자 요청을 확장합니다. 이 과정에서 검색된 문서를 사용자 질의에 병합하여 컨텍스트를 보강합니다. 결과적으로 모델은 더 나은 정보를 바탕으로 응답을 생성할 수 있습니다.

-

생성(Generate): 최종적으로 LLM이 사용자의 요청과 검색된 문서를 바탕으로 텍스트 응답을 생성합니다. 이 단계에서 생성된 텍스트는 정보의 최신성과 정확성을 보장합니다.

Advanced RAG Cookbooks의 주요 내용

RAG는 다양한 기술과 방법론을 포함하며, 특정 상황에 맞게 적용됩니다. 노트북 링크와 함께 참고해주세요:

Advanced RAG Cookbooks 사용법

- GitHub 저장소 복제 및 구성:

git clone https://github.com/athina-ai/rag-cookbooks.git명령어를 사용해 저장소를 복제합니다.

- 주요 라이브러리 설치:

- Python 환경에서

pip install langchain등 필요한 패키지를 설치합니다.

- 노트북 실행:

- Jupyter 노트북에서 제공된 각 기술별 구현을 실행하며 테스트합니다.

라이선스

Advanced RAG Cookbooks는 MIT License로 공개되었습니다.

Advanced RAG Cookbooks GitHub 저장소

Advanced RAG Cookbooks GitHub 저장소

이 글은 GPT 모델로 정리한 글을 바탕으로 한 것으로, 원문의 내용 또는 의도와 다르게 정리된 내용이 있을 수 있습니다. 관심있는 내용이시라면 원문도 함께 참고해주세요! 읽으시면서 어색하거나 잘못된 내용을 발견하시면 덧글로 알려주시기를 부탁드립니다. ![]()

파이토치 한국 사용자 모임

![]() 이 정리한 이 글이 유용하셨나요? 회원으로 가입하시면 주요 글들을 이메일

이 정리한 이 글이 유용하셨나요? 회원으로 가입하시면 주요 글들을 이메일![]() 로 보내드립니다! (기본은 Weekly지만 Daily로 변경도 가능합니다.)

로 보내드립니다! (기본은 Weekly지만 Daily로 변경도 가능합니다.)

![]() 아래

아래![]() 쪽에 좋아요

쪽에 좋아요![]() 를 눌러주시면 새로운 소식들을 정리하고 공유하는데 힘이 됩니다~

를 눌러주시면 새로운 소식들을 정리하고 공유하는데 힘이 됩니다~ ![]()