이 기사는 AI타임즈의 허락을 받아 게재하였습니다. 자세한 정보는 아래의 본문 링크를 참조해주세요. ![]()

...(중략)... 딥마인드(Deepmind)와 구글 AI(Google Research, Brain Team) 공동 연구팀이 트랜스포머를 사용하여 범용 하이퍼매개변수 최적화 도구를 학습하는 방법(Towards Learning Universal Hyperparameter Optimizers with Transformers-다운)인 세계 최초의 텍스트 기반 트랜스포머 HPO(hyperparameter optimization) 프레임워크 '옵트포머(OptFormer)'를 지난 18일 공개했다.

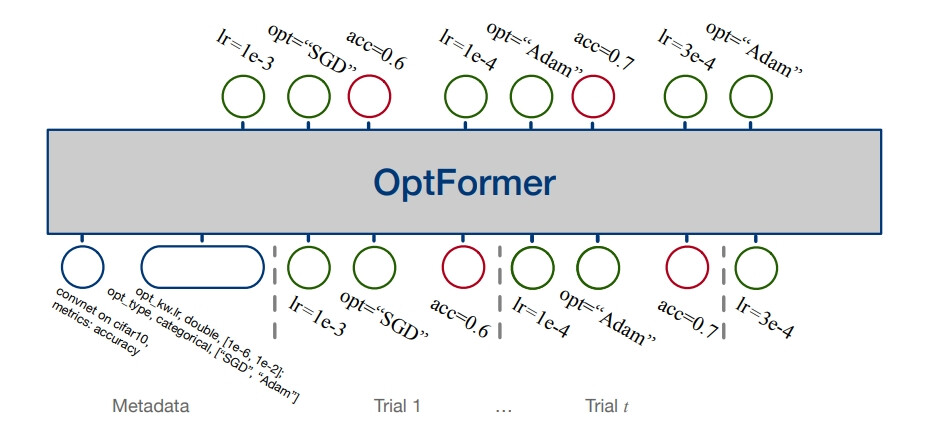

연구팀에 따르면 옵트포머는 광범위한 튜닝 데이터를 학습할 때 정책과 함수 예측을 공동으로 학습할 수 있는 범용 엔드 투 엔드 인터페이스를 제공한다.

또, 적어도 7개의 다른 HPO 알고리즘을 모방할 수 있다는 것을 보여주며, 이는 함수 불확실성 추정을 통해 더욱 개선될 수 있다. ...(후략)...