COMPL-AI 소개

COMPL-AI(Compliance-centered Evaluation Framework) 는 생성형 AI 모델(Generative AI)이 EU AI 법(EU AI Act) 및 기타 규제 요구사항을 준수하는지 기술적으로 평가하기 위해 개발된 오픈소스 프레임워크입니다. ETH 취리히(ETH Zurich), INSAIT, LatticeFlow AI가 공동으로 개발 및 유지관리를 하고 있습니다.

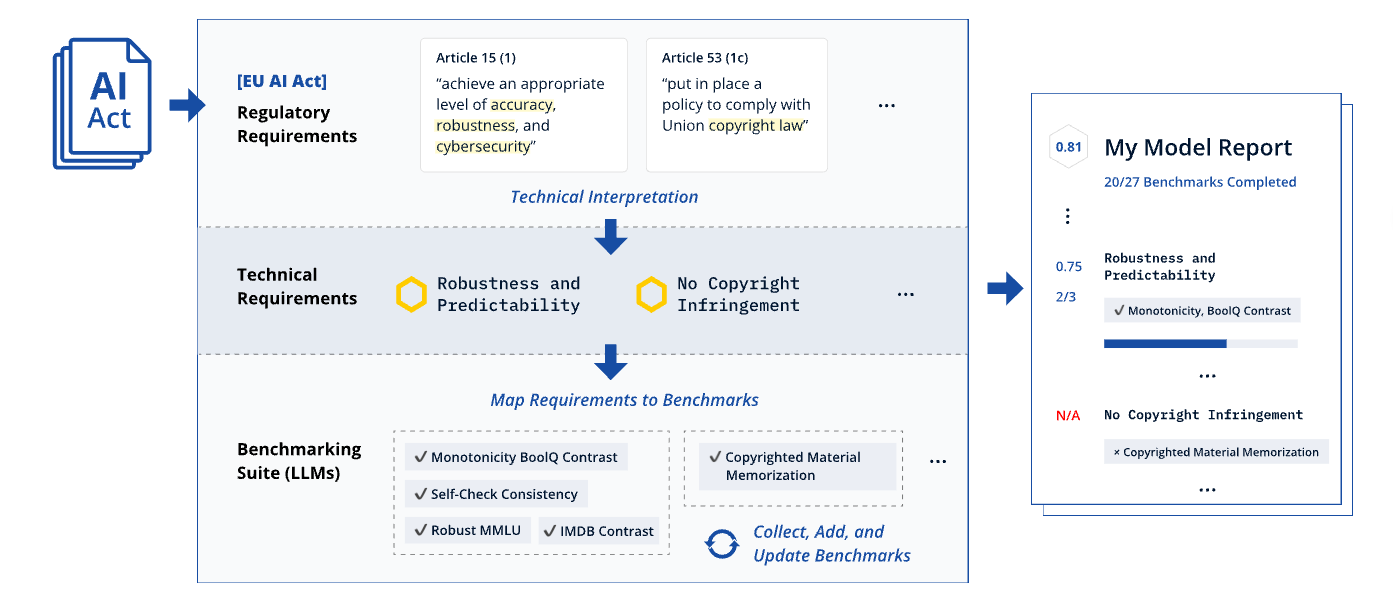

AI 기술의 발전과 함께 AI 규제(특히 EU AI Act)가 구체화되고 있지만, 법률적인 규제 조항을 실제 개발 현장의 기술적 요구사항(Technical Requirements)으로 변환하는 것은 매우 어려운 과제였습니다. COMPL-AI는 이러한 격차를 해소하기 위해 등장했습니다. 이 프레임워크는 모호할 수 있는 법적 규제 조항을 '측정 가능한 기술적 벤치마크'로 해석하고, 이를 실행 가능한 코드로 제공하여 개발자가 자신의 LLM 애플리케이션이 규제를 준수하는지 자동으로 테스트하고 점수화(Scorecard) 할 수 있도록 돕습니다.

COMPL-AI는 단순히 모델의 성능(Capability)만을 측정하는 것이 아니라, 공정성(Fairness), 편향(Bias), 독성(Toxicity), 사이버 보안(Cyberattack Resilience) 등 규제 관점에서 필수적인 요소들을 중점적으로 평가합니다. 이를 통해 개발팀과 법무팀은 AI 모델의 리스크를 정량적으로 파악하고, 배포 전 규제 준수 여부를 체계적으로 검증할 수 있습니다.

COMPL-AI vs. 수동 감사(Manual Audits)

기존의 AI 규제 준수 여부 확인은 주로 법률 전문가에 의한 수동 감사나 체크리스트 방식에 의존했습니다. 이는 시간이 오래 걸리고, 기술적인 세부 사항을 놓치기 쉬우며, 정량적인 수치로 증명하기 어렵다는 단점이 있었습니다.

COMPL-AI는 이러한 과정을 자동화된 벤치마크 테스트로 전환합니다. 즉, MMLU-Pro, BBQ, Toxicity Prompts 등 검증된 데이터셋을 활용하여 일관된 기준을 적용하여 표준화된 평가 기준을 마련합니다. 또한, EU AI Act의 투명성 요건과 같은 법적 조항과 기술적 테스트를 1:1로 매핑하여, 특정 테스트 실패가 어떤 법적 리스크로 이어지는지 명확히 보여줍니다. 이러한 방식을 통해 새로운 규제나 모델이 등장하더라도 구성(Config) 파일과 벤치마크 세트를 업데이트하여 유연하게 대응할 수 있습니다.

COMPL-AI의 주요 기능

COMPL-AI는 크게 기술적 해석(Technical Interpretation) 과 벤치마킹 스위트(Benchmarking Suite) 두 가지 핵심 요소로 구성됩니다:

-

규제의 기술적 해석 (Technical Interpretation): EU AI Act와 같은 고수준의 법적 요구사항을 개발자가 이해할 수 있는 구체적인 기술적 요구사항으로 번역합니다. 주요 평가 항목은 다음과 같은 6가지 원칙을 기반으로 합니다:

-

인간의 감독 (Human Agency and Oversight)

-

기술적 견고성 및 안전성 (Technical Robustness and Safety)

-

프라이버시 및 데이터 거버넌스 (Privacy and Data Governance)

-

투명성 (Transparency)

-

다양성, 비차별 및 공정성 (Diversity, Non-discrimination, and Fairness)

-

사회적 및 환경적 웰빙 (Societal and Environmental Well-being)

-

-

오픈소스 벤치마킹 스위트 (Open-Source Benchmarking Suite): COMPL-AI는 Inspect AI 평가 프레임워크를 기반으로 구축되었습니다. 사용자는 CLI(명령줄 인터페이스)를 통해 손쉽게 모델을 평가할 수 있습니다.

COMPL-AI 설치 및 실행 방법

COMPL-AI는 아래와 같이 Python 환경에서 uv 또는 pip를 사용하여 설치할 수 있습니다:

# 저장소 클론 및 가상 환경 설정

git clone https://github.com/compl-ai/compl-ai.git

cd compl-ai

uv sync # 또는 필요한 의존성 설치

source .venv/bin/activate

# API 키 설정 (예: OpenAI)

export OPENAI_API_KEY=your_key

# 단일 벤치마크 실행 (예: GPT-4o Mini 모델에 대해 MMLU Pro 테스트)

complai eval openai/gpt-4o-mini --tasks mmlu_pro --limit 5

설정 및 커스터마이징

기본 설정 파일(default_config.yaml)을 복사하여 자신만의 테스트 구성을 만들 수 있습니다. 특정 규제 항목만 골라서 테스트하거나, 로컬 모델(Hugging Face, vLLM)을 대상으로 테스트하는 것도 가능합니다.

# 로컬 모델 평가 예시 (Hugging Face)

complai eval hf/Qwen/Qwen2.5-7B-Instruct -t mmlu_pro -M device=cuda:0

평가 결과 및 리포트

평가가 완료되면 각 항목별 점수와 규제 준수 여부가 포함된 리포트가 생성됩니다. 사용자는 inspect view 명령어를 통해 브라우저에서 시각화된 결과를 확인할 수 있으며, 이를 통해 어떤 영역(예: 편향성, 보안)이 취약한지 즉시 파악할 수 있습니다.

라이선스

COMPL-AI 프로젝트는 Apache License 2.0으로 배포되고 있습니다.12 상업적 이용, 수정 및 배포가 자유로운 편입니다.

(라이선스 확인: LICENSE)

COMPL-AI 공식 홈페이지

COMPL-AI 공식 홈페이지

COMPL-AI 관련 논문: COMPL-AI Framework: A Technical Interpretation and LLM Benchmarking Suite for the EU Artificial Intelligence Act

COMPL-AI 관련 논문: COMPL-AI Framework: A Technical Interpretation and LLM Benchmarking Suite for the EU Artificial Intelligence Act

COMPL-AI 프로젝트 GitHub 저장소

COMPL-AI 프로젝트 GitHub 저장소

https://github.com/compl-ai/compl-ai

더 읽어보기

-

EU 인공지능법 (EU AI Act): https://artificialintelligenceact.eu/

-

미국 표준기술연구소 AI 위험 관리 프레임워크 (NIST AI RMF): AI Risk Management Framework | NIST

-

AI 경영 시스템 국제 표준 (ISO/IEC 42001): ISO/IEC 42001:2023 - AI management systems

이 글은 GPT 모델로 정리한 글을 바탕으로 한 것으로, 원문의 내용 또는 의도와 다르게 정리된 내용이 있을 수 있습니다. 관심있는 내용이시라면 원문도 함께 참고해주세요! 읽으시면서 어색하거나 잘못된 내용을 발견하시면 덧글로 알려주시기를 부탁드립니다. ![]()

파이토치 한국 사용자 모임

![]() 이 정리한 이 글이 유용하셨나요? 회원으로 가입하시면 주요 글들을 이메일

이 정리한 이 글이 유용하셨나요? 회원으로 가입하시면 주요 글들을 이메일![]() 로 보내드립니다! (기본은 Weekly지만 Daily로 변경도 가능합니다.)

로 보내드립니다! (기본은 Weekly지만 Daily로 변경도 가능합니다.)

![]() 아래

아래![]() 쪽에 좋아요

쪽에 좋아요![]() 를 눌러주시면 새로운 소식들을 정리하고 공유하는데 힘이 됩니다~

를 눌러주시면 새로운 소식들을 정리하고 공유하는데 힘이 됩니다~ ![]()