9bow

(박정환)

1

GeekNews의 xguru님께 허락을 받고 GN에 올라온 글들 중에 AI 관련된 소식들을 공유하고 있습니다.

소개

- Meta가 Llama 2를 기반으로 구축된 코딩 전용 모델인 Code Llama를 공개.

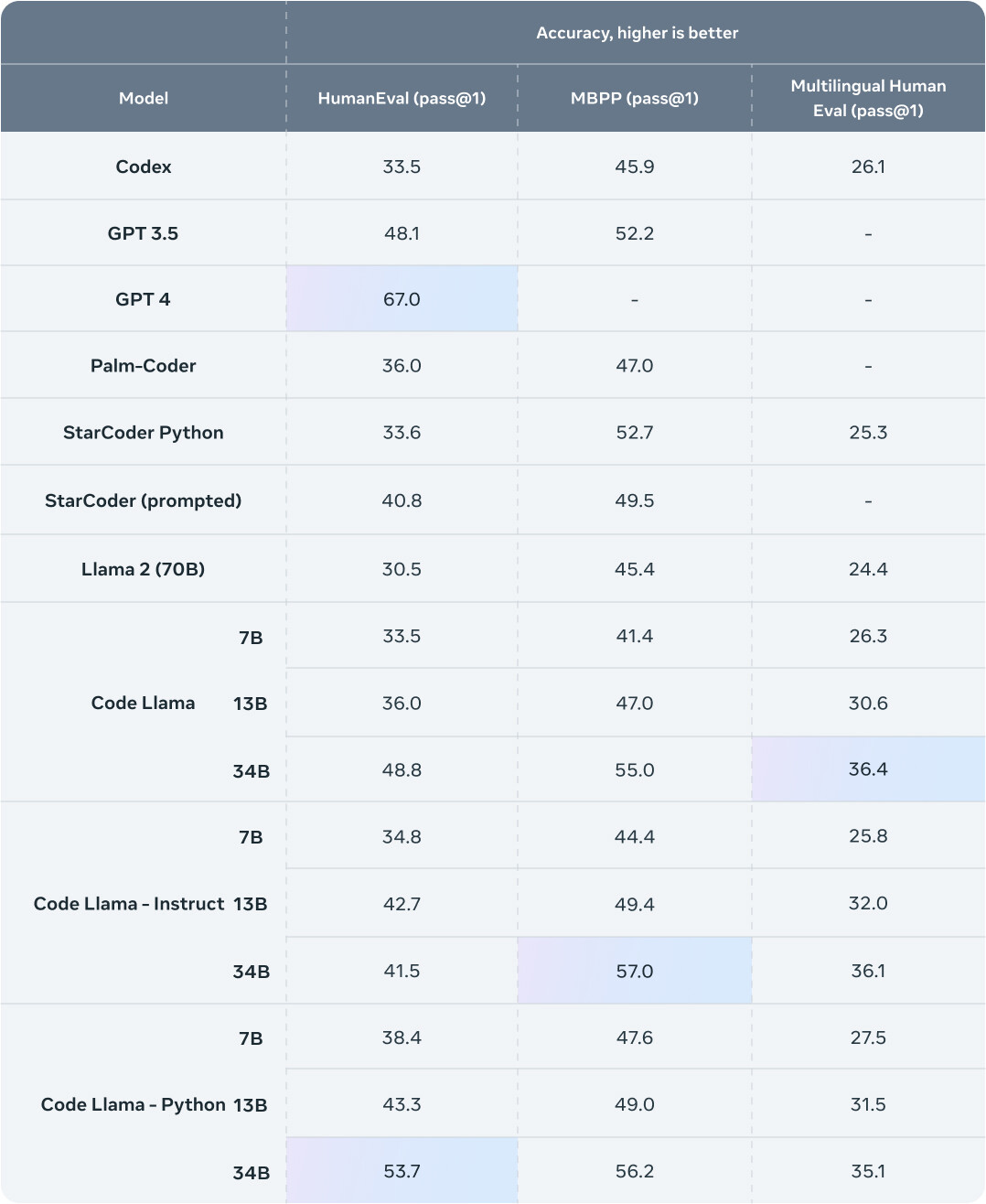

- 코드와 자연어 프롬프트에서 코드 생성이 가능하며, 자체 벤치마크 결과 ChatGPT보다 성능이 뛰어났음.

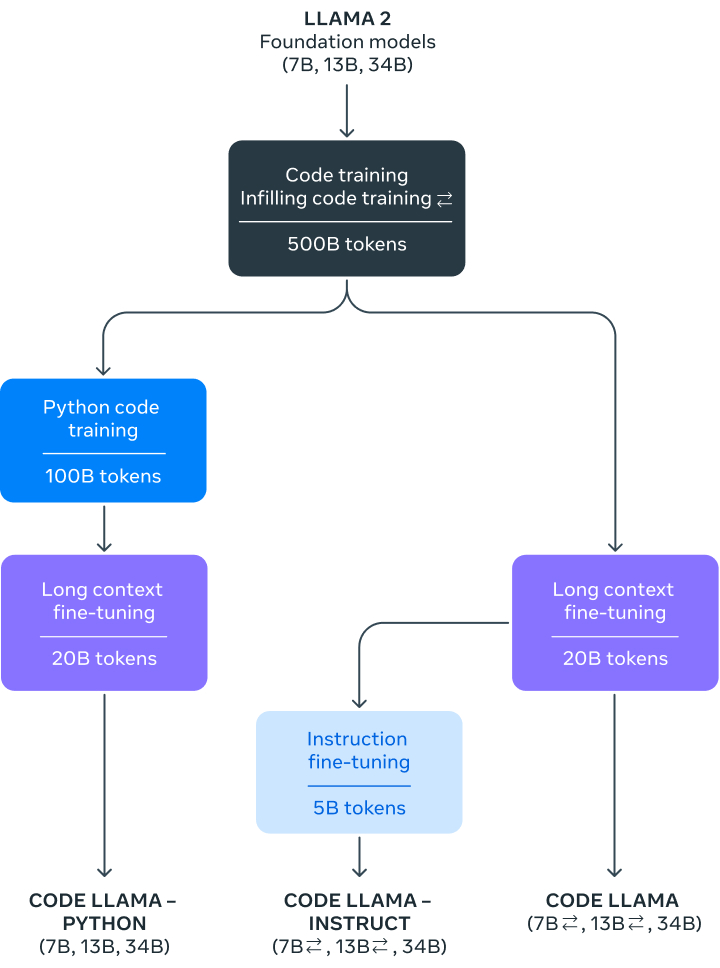

- 5,000억 개의 코드 토큰과 관련 데이터로 훈련된 7B, 13B, 34B 모델을 각각 출시.

- 최대 10만 개의 컨텍스트 토큰을 지원하여 더 긴 프로그램을 작성하거나 상세한 조건, 실제 코드를 프롬프트로 입력하기 용이함.

- Code Llama는 원본 모델 말고도 2가지 추가 변형으로 출시함.

- Code Llama - Python: 1,000억 개의 Python 코드 토큰을 추가하여 미세 조정한 모델.

- Code Llama - Instruct: 50억 개의 명령 토큰으로 미세 조정한 자연어 입력과 코드 출력에 최적화된 모델.

- 다른 모델은 자연어에 최적화 되어 있지 않아 자연어를 통해 코드를 생성할 때는 이 모델을 사용해야 함.

- HumanEval, MBPP를 통해 모델의 성능을 측정한 결과 ChatGPT (GPT 3.5) 와 동등하거나 성능이 높은 것으로 나타남.

- GPT 3.5가 HumanEval에서 48.1%를 기록할 때 Code Llama - Python은 53.7%를 기록함.

- GPT 4는 67%로 아직 갈 길이 남아 있음.

- Code Llama가 악성 코드를 생성할 수 있는 위험을 최소화하기 위해 다양한 안전 조치를 추가함.

- 실제 테스트를 해 보니 ChatGPT에 비해 더 적은 악성 코드를 생성하는 것으로 나타남.

원문

블로그

논문

가중치 다운로드(요청)

GitHub 저장소

https://github.com/facebookresearch/codellama

1개의 좋아요

9bow

(박정환)

2

- 이 글은 GPT 모델로 자동 요약한 설명으로, 잘못된 내용이 있을 수 있으니 원문을 참고해주세요!

- 읽으시면서 어색하거나 잘못된 내용을 발견하시면 덧글로 알려주시기를 부탁드립니다!

Code-LLaMA 소개: 최첨단 대형 언어 모델 (Introducing Code Llama, a state-of-the-art large language model for coding)

소개

- 코드 라마(Code LLaMA)는 코드 및 코드에 대한 자연어를 생성할 수 있는 최첨단 LLM입니다.

- 이 모델은 연구 및 상업적 용도로 무료로 사용할 수 있습니다.

- 코드 라마(Code LLaMA)의 목적은 개발자의 작업 흐름을 더 빠르고 효율적으로 만들고, 코딩을 배우는 사람들의 진입 장벽을 낮추는 것입니다.

주요 내용

Code Llama는 어떻게 동작하나요?

- Code LLaMA는 Code를 전문적으로 학습한 Llama 2 버전으로, Llama 2의 코드 특정 데이터셋에서 더 많은 데이터를 샘플링하여 추가 학습되었습니다.

- 이 모델은 코드 및 자연어 프롬프트 모두에서 코드 및 코드에 대한 자연어를 생성할 수 있습니다.

- 코드 라마는 Python, C++, Java, PHP, Typescript (Javascript), C#, 및 Bash와 같은 오늘날 가장 인기 있는 언어를 지원합니다.

Code Llama 모델 종류

- 코드 라마는 7B, 13B, 34B 매개 변수의 세 가지 크기로 출시되었습니다.

- 이 모델들은 코드 및 코드 관련 데이터의 500B 토큰으로 학습되었습니다.

- 7B 및 13B 기본 및 지시 모델은 코드를 기존 코드에 삽입할 수 있도록 학습되었습니다.

Code Llama의 추가적인 버전들

-

추가로, Code LLaMA - Python 및 Code LLaMA - Instruct의 두 가지 변형이 더 세밀하게 조정되었습니다.

-

Code LLaMA - Python은 파이썬 코드의 100B 토큰에 더 세밀하게 조정된 코드 라마의 언어 전문 변형입니다.

-

Code LLaMA - Instruct는 코드 라마의 지시 조정 및 정렬 변형입니다.

Code Llama의 성능 평가

Code Llama 출시

Responsible use

- 우리의 연구 논문은 코드 라마의 개발에 대한 세부 사항과 벤치마킹 테스트를 어떻게 수행했는지에 대한 정보를 제공합니다.

The future of generative AI for coding

더 읽어보기

https://github.com/facebookresearch/codellama

- 코드 라마 모델을 다운로드 할 수 있는 링크입니다.

원문

![]()