Hunyuan3D 소개

Hunyuan3D-1.0은 텐센트가 개발한 통합 3D 생성 프레임워크로, 텍스트 및 이미지 기반의 3D 생성을 지원합니다. 기존의 디퓨전(diffusion) 기반 3D 생성 모델은 느린 생성 속도와 낮은 범용성이라는 한계가 있습니다. Hunyuan3D-1.0은 이러한 문제를 해결하기 위해 설계되었으며, 효율적인 두 단계 생성 방식을 통해 보다 빠른 속도로 고품질 3D 자산을 생성합니다.

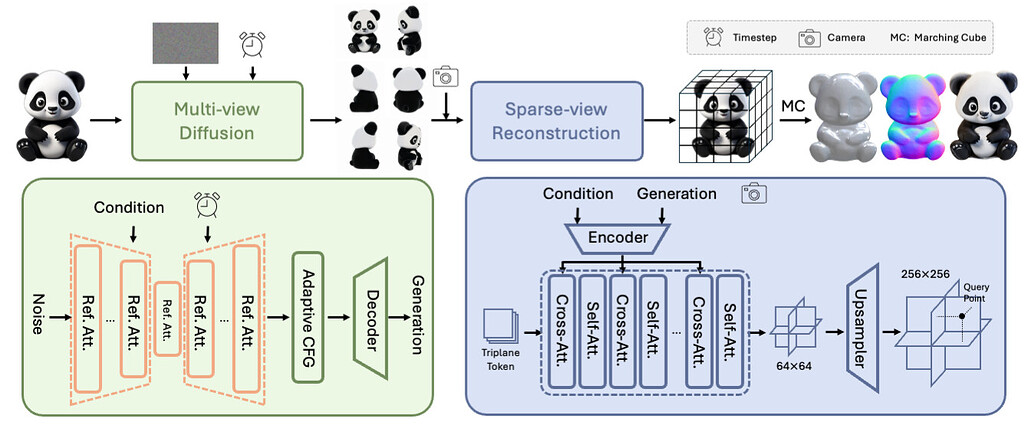

Hunyuan3D 아키텍처 개요

Hunyuan3D 은 다중 시점 디퓨전 모델(multi-view diffusion model)과 피드포워드 재구성 모델로 구성된 2단계 모델 아키텍처를 사용합니다. 이 구조는 단일 시점으로부터 복잡한 다중 시점을 처리하는 대신, 텍스트나 이미지 프롬프트를 기반으로 다양한 각도에서 촬영한 것과 같은 다중 시점 RGB 이미지를 생성합니다.

이 아키텍처는 특히 고해상도의 다각도 이미지를 생성하여, 3D 객체의 복잡한 디테일과 구조를 유지하며 3D 모델을 재구성할 수 있습니다. Hunyuan-DiT라는 텍스트-이미지 변환 모델이 추가되어, 텍스트 기반과 이미지 기반 3D 생성이 모두 가능하게 설계되었습니다.

Hunyuan3D-1.0의 생성 과정은 크게 두 단계로 구성됩니다.

첫 번째 단계에서 사용되는 다중 시점 디퓨전 모델은 입력된 텍스트나 이미지 프롬프트에 따라 여러 시점에서 촬영한 이미지들을 생성합니다. 이 과정에서 각도와 조명을 다양하게 적용하여, 생성된 이미지들이 3D 객체의 각 시점에서의 디테일을 포착하도록 합니다.

- 다중 시점 생성의 장점: 기존의 단일 시점 3D 생성 모델들은 하나의 이미지에서 모든 3D 정보를 복원하는데 어려움을 겪었으나, Hunyuan3D-1.0의 다중 시점 접근 방식은 이러한 한계를 극복할 수 있게 합니다.

- 속도: 이 단계는 약 4초 정도 소요되며, 고속 생성이 가능합니다.

두 번째 단계는 피드포워드 재구성 모델을 사용하여 다중 시점 이미지를 기반으로 3D 메쉬를 생성합니다. 이 모델은 다중 시점 디퓨전 과정에서 발생하는 노이즈와 불일치를 효율적으로 처리하여 정확한 3D 구조를 빠르게 재구성합니다.

- 노이즈 처리: 디퓨전 과정에서 발생할 수 있는 노이즈나 시점 간 불일치를 보정하여 보다 자연스럽고 정교한 3D 모델을 생성합니다.

- 속도: 이 단계는 약 7초 내외로 완료되어 전체 생성 시간은 10초 이내로 유지됩니다.

Hunyuan3D 기술 문서

Hunyuan3D 기술 문서

Hunyuan3D GitHub 저장소

Hunyuan3D GitHub 저장소

Hunyuan3D 모델 저장소

Hunyuan3D 모델 저장소

이 글은 GPT 모델로 정리한 글을 바탕으로 한 것으로, 원문의 내용 또는 의도와 다르게 정리된 내용이 있을 수 있습니다. 관심있는 내용이시라면 원문도 함께 참고해주세요! 읽으시면서 어색하거나 잘못된 내용을 발견하시면 덧글로 알려주시기를 부탁드립니다. ![]()

파이토치 한국 사용자 모임

![]() 이 정리한 이 글이 유용하셨나요? 회원으로 가입하시면 주요 글들을 이메일

이 정리한 이 글이 유용하셨나요? 회원으로 가입하시면 주요 글들을 이메일![]() 로 보내드립니다! (기본은 Weekly지만 Daily로 변경도 가능합니다.)

로 보내드립니다! (기본은 Weekly지만 Daily로 변경도 가능합니다.)

![]() 아래

아래![]() 쪽에 좋아요

쪽에 좋아요![]() 를 눌러주시면 새로운 소식들을 정리하고 공유하는데 힘이 됩니다~

를 눌러주시면 새로운 소식들을 정리하고 공유하는데 힘이 됩니다~ ![]()