InternVL3 모델 소개

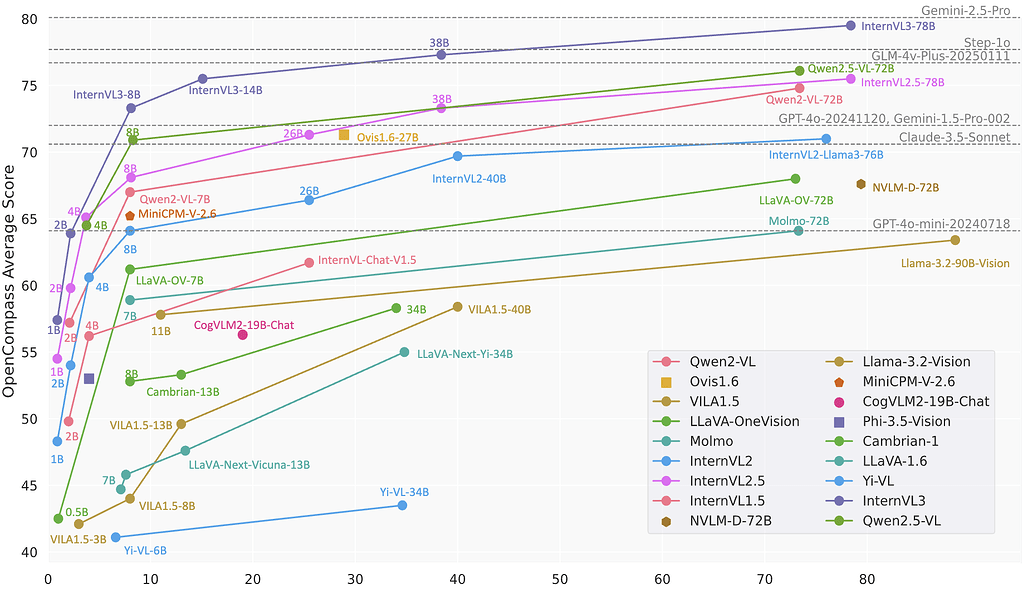

InternVL 시리즈가 드디어 3.0으로 업데이트되었습니다. GPT-4o, Claude 3.5 Sonnet, Gemini 2.5 Pro 같은 상용 모델들과도 견줄 수 있는 오픈소스 멀티모달 모델로, 특히 영상, 문서, 차트, GUI 조작까지 가능합니다.

InternVL3는 멀티모달 대형 언어 모델(MLLM) 중 최초로 네이티브 멀티모달 사전 학습(Native Multimodal Pre-Training)을 도입해, 텍스트와 비전 데이터를 동시에 사전 학습합니다. 기존의 MLLM들은 텍스트 전용 LLM을 사전 학습한 후 비전 기능을 “붙이는” 방식이었다면, InternVL3는 처음부터 멀티모달 구조로 학습이 진행됩니다.

이로 인해 모달리티 간 정렬 문제를 크게 줄일 수 있었고, 성능 또한 자연스럽게 향상되었습니다. 특히 도큐먼트, 차트, OCR, 영상, GUI 조작 등 실제 사용 가능한 멀티모달 태스크에서 강력한 성능을 보입니다.

InternVL3와 다른 모델들을 비교해보면 다음과 같습니다:

- GPT-4o, Claude 3.5, Gemini 2.5 Pro와 비교해도 많은 지표에서 동등하거나 더 우수한 성능

- 오픈소스 중에서는 Qwen2.5-VL, Ovis, MiniCPM 등을 넘어서며 새로운 기준점 제시

- MMMU, MathVista, AI2D, DocVQA, ScreenSpot 등 여러 벤치마크에서 상위권 점수 기록

InternVL3는 아래와 같은 7가지 크기의 모델들로 제공됩니다:

| 모델 이름 | 파라미터 수 | 구성 | 다운로드 링크 |

|---|---|---|---|

| InternVL3-1B | 약 938M | ViT 304M + MLP 4.4M + LLM 630M | 다운로드 |

| InternVL3-2B | 약 2.09B | ViT 304M + MLP 8.6M + LLM 1.78B | 다운로드 |

| InternVL3-8B | 약 7.94B | ViT 304M + MLP 27.5M + LLM 7.61B | 다운로드 |

| InternVL3-9B | 약 9.14B | ViT 304M + MLP 33.6M + LLM 8.80B | 다운로드 |

| InternVL3-14B | 약 15.1B | ViT 304M + MLP 47.2M + LLM 14.8B | 다운로드 |

| InternVL3-38B | 약 38.4B | ViT 5.54B + MLP 91.8M + LLM 32.8B | 다운로드 |

| InternVL3-78B | 약 78.4B | ViT 5.54B + MLP 172M + LLM 72.7B | 다운로드 |

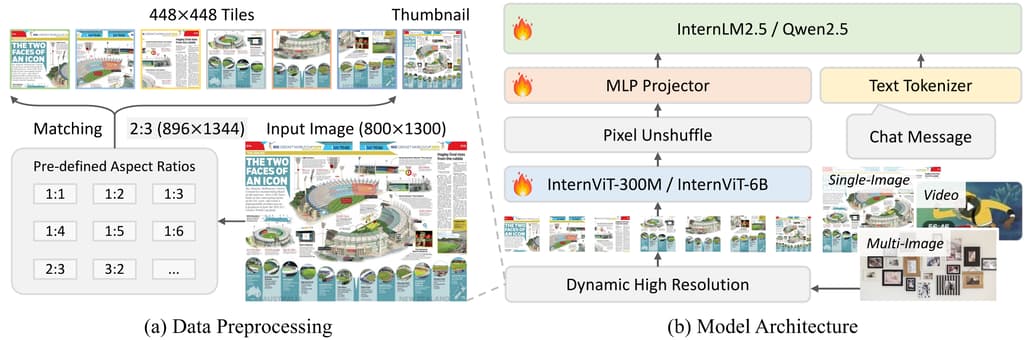

- 입력 해상도는 학습 시 최대 36타일(448x448), 테스트 시 최대 128타일까지 지원

- ViT-MLP-LLM 구조 기반

- Pixel Unshuffle 및 Dynamic Tiling 적용

InternVL3 모델의 주요 특징

- Native Multimodal Pre-Training : 텍스트와 이미지, 영상 데이터를 통합하여 사전학습

- V2PE (Variable Visual Position Encoding) : 긴 시퀀스를 유연하게 처리할 수 있는 시각 위치 인코딩 방식

- Mixed Preference Optimization (MPO) : 추론 중 분포 불일치를 줄이기 위한 CoT 강화 학습

- VisualPRM Best-of-N 평가: 여러 응답 중 최적 결과를 선택해 성능 향상

- InternEVO 학습 프레임워크: 2,000개 이상의 GPU를 활용한 초대규모 분산 학습 구조

InternVL3 홈페이지

InternVL3 홈페이지

InternVL3 데모

InternVL3 데모

InternVL3 기술 문서

InternVL3 기술 문서

InternVL3 GitHub 저장소

InternVL3 GitHub 저장소

InternVL3 모델 다운로드

InternVL3 모델 다운로드

| Model Name | Vision Part | Language Part | HF Link |

|---|---|---|---|

| InternVL3-1B | InternViT-300M-448px-V2_5 | Qwen2.5-0.5B | 🤗 link |

| InternVL3-2B | InternViT-300M-448px-V2_5 | Qwen2.5-1.5B | 🤗 link |

| InternVL3-8B | InternViT-300M-448px-V2_5 | Qwen2.5-7B | 🤗 link |

| InternVL3-9B | InternViT-300M-448px-V2_5 | internlm3-8b-instruct | 🤗 link |

| InternVL3-14B | InternViT-300M-448px-V2_5 | Qwen2.5-14B | 🤗 link |

| InternVL3-38B | InternViT-6B-448px-V2_5 | Qwen2.5-32B | 🤗 link |

| InternVL3-78B | InternViT-6B-448px-V2_5 | Qwen2.5-72B | 🤗 link |

이 글은 GPT 모델로 정리한 글을 바탕으로 한 것으로, 원문의 내용 또는 의도와 다르게 정리된 내용이 있을 수 있습니다. 관심있는 내용이시라면 원문도 함께 참고해주세요! 읽으시면서 어색하거나 잘못된 내용을 발견하시면 덧글로 알려주시기를 부탁드립니다. ![]()

파이토치 한국 사용자 모임

![]() 이 정리한 이 글이 유용하셨나요? 회원으로 가입하시면 주요 글들을 이메일

이 정리한 이 글이 유용하셨나요? 회원으로 가입하시면 주요 글들을 이메일![]() 로 보내드립니다! (기본은 Weekly지만 Daily로 변경도 가능합니다.)

로 보내드립니다! (기본은 Weekly지만 Daily로 변경도 가능합니다.)

![]() 아래

아래![]() 쪽에 좋아요

쪽에 좋아요![]() 를 눌러주시면 새로운 소식들을 정리하고 공유하는데 힘이 됩니다~

를 눌러주시면 새로운 소식들을 정리하고 공유하는데 힘이 됩니다~ ![]()