Phi-3.5 모델 시리즈 소개

Microsoft에서 Phi-3 모델을 개선한 Phi-3.5-mini-instruct와 Phi-3.5-vision-instruct 모델을 공개했습니다. 또한, 16개의 전문가로 이뤄진 Phi-3.5-MoE-insturct 모델도 새롭게 공개했습니다. 각각의 모델은 다음과 같습니다:

Phi-3.5-MoE-Instruct

모델 개요

- Phi-3.5-MoE-Instruct는 다국어 지원이 가능한 경량화된 최첨단 모델입니다.

- 128K 토큰의 컨텍스트 길이를 지원하며, 고품질의 추론 중심 데이터를 바탕으로 만들어졌습니다.

- 모델은 감독된 미세 조정과 최적화를 통해 높은 정확성과 안전성을 제공합니다.

주요 활용 사례

- 메모리/컴퓨팅 제약 환경, 지연 시간이 중요한 시나리오, 코드, 수학, 논리 등 강력한 추론이 필요한 작업에 적합합니다.

벤치마크 성능

- Phi-3.5-MoE는 6.6B 활성 매개변수로도 언어 이해와 수학적 성능에서 경쟁력 있는 성과를 나타냅니다.

- 특히 추론 능력에서 우수한 성과를 보이며, 더 큰 모델들과 유사한 수준의 성능을 제공합니다.

책임 있는 AI 고려 사항

- 다국어 성능 격차, 편향된 표현, 부적절한 콘텐츠 생성 등 다양한 AI 책임 문제를 고려하여 개발되었습니다.

Phi-3.5-MoE-Instruct 모델

Phi-3.5-MoE-Instruct 모델

Phi-3.5-MoE 모델 예시 코드

Phi-3.5-MoE 모델 예시 코드

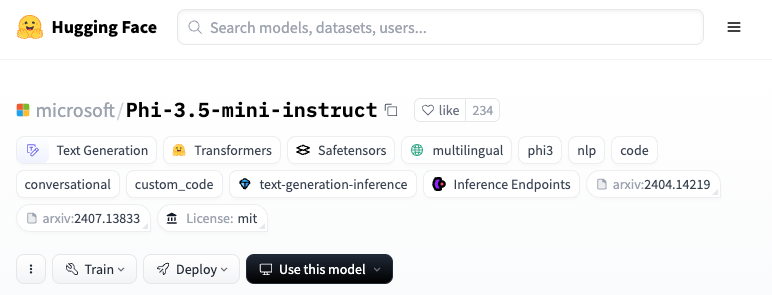

Phi-3.5-Mini-Instruct

모델 개요

- Phi-3.5-Mini-Instruct는 Phi-3 모델을 기반으로 한 경량화된 최신 오픈 모델입니다.

- 3.8B 활성 매개변수로 구성되어 있으며, 128K 토큰의 컨텍스트 길이를 지원합니다.

- 높은 품질의 데이터를 사용하여 매우 정밀한 명령 이행과 안전성을 확보했습니다.

주요 활용 사례

- 다국어 AI 시스템, 메모리/컴퓨팅 제약 환경, 코드, 수학, 논리 추론에 적합합니다.

벤치마크 성능

- Phi-3.5-Mini는 다양한 다국어 벤치마크에서 경쟁력 있는 성능을 보여주며, 특히 롱 컨텍스트 작업에서 우수한 성과를 나타냅니다.

- 다른 대형 모델들과 비교해도 유사한 수준의 다국어 이해와 추론 능력을 보입니다.

책임 있는 AI 고려 사항

- Phi-3.5-Mini는 공정성, 신뢰성, 부적절한 콘텐츠 생성 등의 문제를 해결하기 위해 추가적인 안전 장치를 고려해야 합니다.

Phi-3.5-Mini-Instruct 모델

Phi-3.5-Mini-Instruct 모델

Phi-3.5-Mini-Instruct 모델 예시 코드

Phi-3.5-Mini-Instruct 모델 예시 코드

Phi-3.5-Vision-Instruct

모델 개요

- Phi-3.5-Vision-Instruct는 텍스트와 비전 데이터를 결합한 다중모드 모델입니다.

- 4.2B 파라미터로 구성되어 있으며, 128K 토큰의 컨텍스트 길이를 지원합니다.

- 이미지 인식, 차트/테이블 이해, 다중 이미지 비교 및 비디오 요약과 같은 작업에 탁월한 성능을 발휘합니다.

주요 활용 사례

- 상용 및 연구 목적의 다중모드 AI 시스템에 적합하며, 이미지와 텍스트 데이터를 결합한 작업에서 강점을 보입니다.

벤치마크 성능

- Phi-3.5-Vision은 다중 이미지 비교, 비디오 요약 등에서 경쟁 모델을 능가하는 성능을 보여줍니다.

- 단일 이미지와 다중 이미지 작업 모두에서 우수한 성과를 기록했습니다.

책임 있는 AI 고려 사항

- 다중모드 AI 시스템에서의 편향된 결과, 부적절한 콘텐츠 생성 등 잠재적인 문제를 해결하기 위해 추가적인 안전 장치가 필요합니다.

Phi-3.5-Vision-Instruct 모델

Phi-3.5-Vision-Instruct 모델

Phi-3.5-Vision-Instruct 모델 예시 코드

Phi-3.5-Vision-Instruct 모델 예시 코드

Phi-3 관련 글들 더 읽어보기

이 글은 GPT 모델로 정리한 글을 바탕으로 한 것으로, 원문의 내용 또는 의도와 다르게 정리된 내용이 있을 수 있습니다. 관심있는 내용이시라면 원문도 함께 참고해주세요! 읽으시면서 어색하거나 잘못된 내용을 발견하시면 덧글로 알려주시기를 부탁드립니다. ![]()

파이토치 한국 사용자 모임

![]() 이 정리한 이 글이 유용하셨나요? 회원으로 가입하시면 주요 글들을 이메일

이 정리한 이 글이 유용하셨나요? 회원으로 가입하시면 주요 글들을 이메일![]() 로 보내드립니다! (기본은 Weekly지만 Daily로 변경도 가능합니다.)

로 보내드립니다! (기본은 Weekly지만 Daily로 변경도 가능합니다.)

![]() 아래

아래![]() 쪽에 좋아요

쪽에 좋아요![]() 를 눌러주시면 새로운 소식들을 정리하고 공유하는데 힘이 됩니다~

를 눌러주시면 새로운 소식들을 정리하고 공유하는데 힘이 됩니다~ ![]()