OmniBind 소개

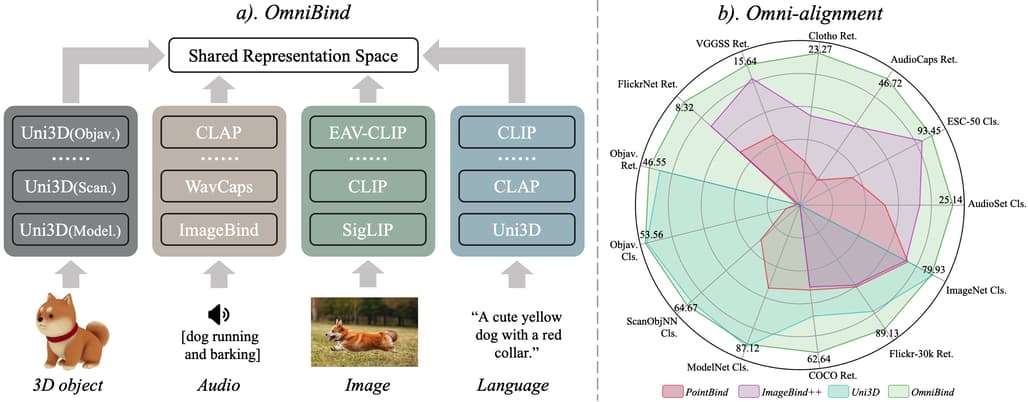

OmniBind는 7억에서 30억 개의 매개변수로 구성된 대규모 멀티모달 조인트 표현 모델로, 3D, 오디오, 이미지, 언어 입력을 모두 지원합니다. 이 모델의 핵심은 기존에 사전 학습된 전문 모델들의 공간을 결합하고 재매핑함으로써 새로운 데이터 쌍을 생성하지 않고도 모델의 규모를 간접적으로 확장할 수 있다는 점입니다. 이를 통해 OmniBind는 다양한 모달리티 간의 조인트 표현을 효과적으로 학습하고, 이를 바탕으로 다양한 AI 응용 프로그램에서 활용할 수 있는 높은 성능을 자랑합니다.

OmniBind는 이러한 조인트 표현을 위해 경량의 네트워크를 사용하여 모델의 효율성을 극대화했습니다. 예를 들어, 30억 개의 매개변수를 가진 가장 큰 모델도 단 8개의 4090 GPU를 사용해 약 3일 만에 학습이 가능합니다. 이는 기존의 대규모 모델들이 필요로 하는 방대한 데이터와 학습 자원에 비해 매우 경제적이고 효율적인 접근 방식입니다. 이러한 효율성 덕분에 OmniBind는 다양한 모달리티를 결합한 AI 응용 프로그램에서 매우 강력한 도구로 자리잡을 수 있습니다.

OmniBind의 주요 특징

OmniBind는 기존의 멀티모달 모델들과 비교했을 때, 여러 면에서 차별화된 특징을 가지고 있습니다:

첫째, GPT-4o나 Gemini와 같은 모델들은 주로 텍스트와 이미지 같은 특정 모달리티 쌍에 초점을 맞추고 있는 반면, OmniBind는 3D, 오디오, 이미지, 언어 등 다양한 모달리티를 동시에 지원합니다. 이는 다양한 입력 데이터를 처리해야 하는 복잡한 AI 애플리케이션에 더 적합한 모델임을 의미합니다.

둘째, OmniBind는 기존의 사전 학습된 모델들을 결합하는 독창적인 방식으로 학습 효율성을 극대화합니다. 일반적으로 대규모 멀티모달 모델을 처음부터 학습하려면 막대한 양의 데이터와 자원이 필요하지만, OmniBind는 이미 학습된 모델들의 공간을 재매핑하고 결합함으로써 이러한 문제를 해결했습니다. 이러한 방식은 모델의 규모를 확장하면서도 필요한 자원을 절감할 수 있는 효과적인 방법입니다.

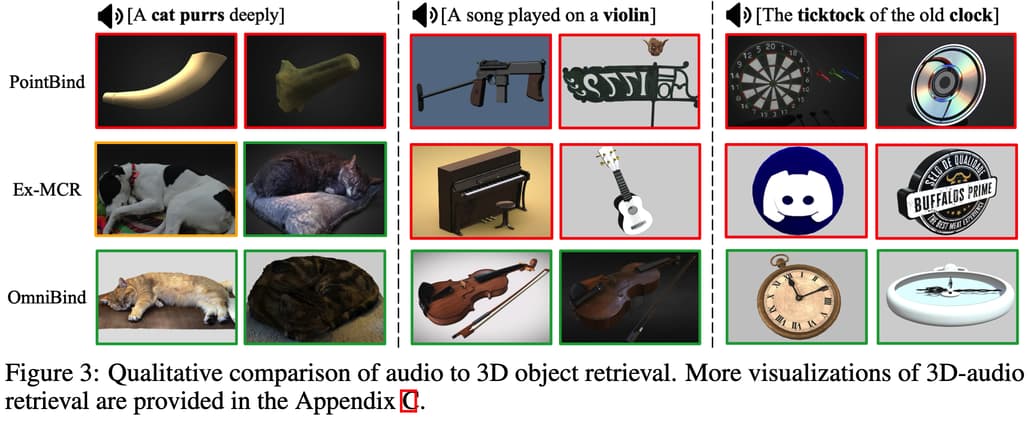

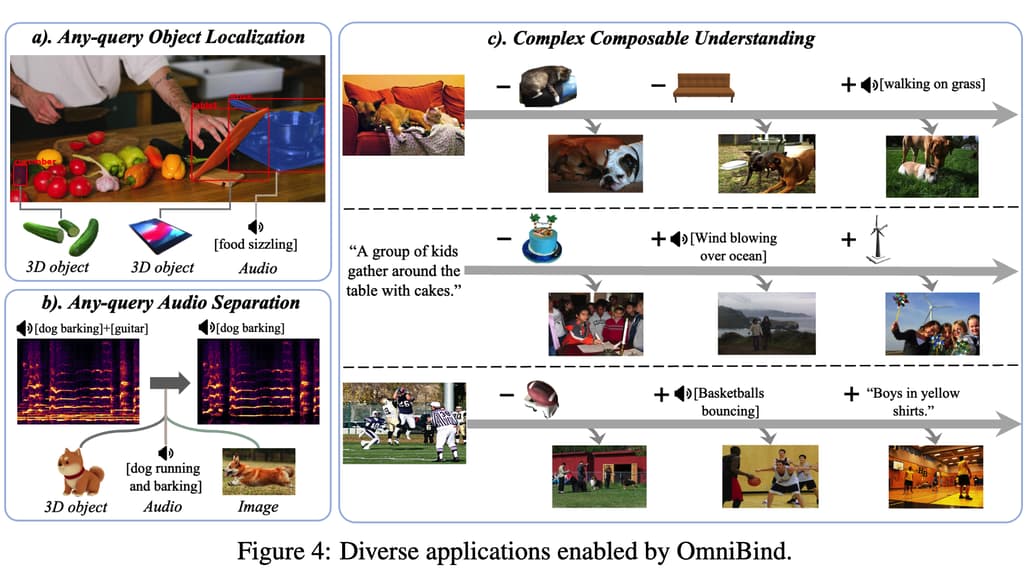

마지막으로, OmniBind는 다양한 모달리티 간의 고품질 조인트 표현을 통해 다양한 AI 애플리케이션에서 우수한 성능을 발휘할 수 있습니다. 예를 들어, 3D와 오디오 데이터를 결합하여 물체 인식이나 소리 분리 작업에서 높은 정확도를 보여줍니다. 이는 기존의 멀티모달 모델들이 제공하지 못했던 새로운 가능성을 제시하며, OmniBind의 기술적 우수성을 입증하는 사례입니다.

OmniBind 구조 및 동작 방식

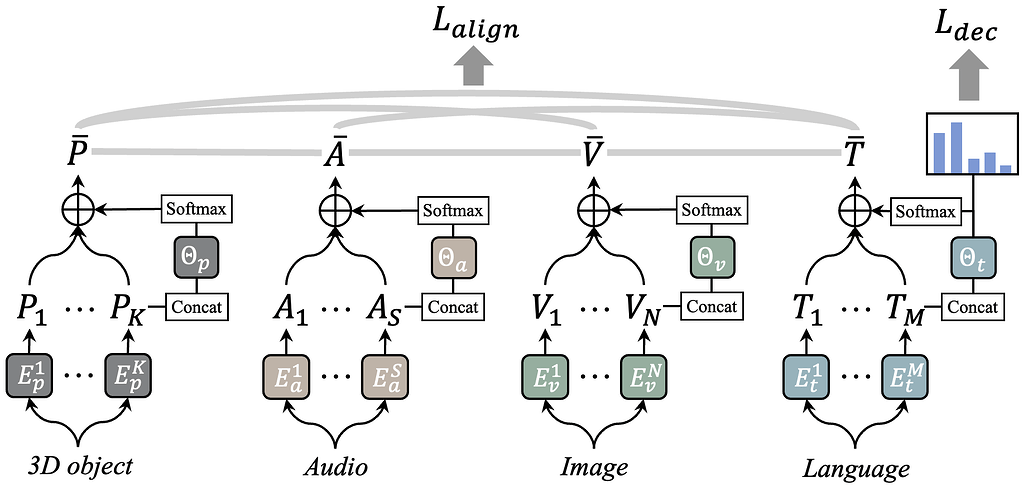

OmniBind는 기존의 사전 학습된 모델들을 결합하여 다양한 모달리티를 처리하는 방식으로 동작합니다. 예를 들어, 3D 데이터를 오디오와 결합하거나, 이미지와 언어를 통합하여 다양한 AI 애플리케이션에서 활용할 수 있습니다. OmniBind의 핵심 기술은 각 모달리티 간의 조인트 표현을 학습하는 데 있습니다. 이를 통해, 다양한 입력 데이터를 효율적으로 처리하고, 고품질의 결과를 얻을 수 있습니다.

이러한 OmniBind 아키텍처의 중심에는 학습된 동적 라우터가 있습니다. 이 라우터는 다양한 입력 공간에 가중치를 할당하는 중요한 역할을 하며, 작업에 따라 특정 데이터 유형을 우선시할 수 있게 합니다. 예를 들어, 시각적 및 텍스트 정보를 필요로 하는 작업에서는 라우터가 이미지 및 언어 공간에 더 높은 가중치를 할당하여 이러한 모달리티가 최종 출력에서 더 두드러지게 나타나도록 합니다. 이러한 동적 라우팅 메커니즘은 모델이 다양한 멀티모달 작업을 높은 정확도와 효율성으로 처리할 수 있게 하는 핵심 요소입니다.

또한 OmniBind의 아키텍처에는 크로스모달 정렬과 언어 표현 디커플링을 위한 메커니즘이 포함되어 있습니다. 크로스모달 정렬은 모델이 다양한 모달리티의 정보를 효과적으로 결합할 수 있게 하여, 입력 데이터의 보다 통합되고 포괄적인 표현을 생성할 수 있게 합니다. 언어 표현 디커플링은 다른 모달리티와 분리하여 언어 처리 구성 요소를 고립시킴으로써, 보다 집중적이고 효과적인 언어 이해를 가능하게 합니다. 이러한 아키텍처적 특징들은 OmniBind를 강력할 뿐만 아니라 유연하게 만들어, 다양한 작업과 데이터 유형에 적응할 수 있게 합니다.

OmniBind를 사용하려면, 먼저 사전 학습된 모델들을 결합하는 과정이 필요합니다. 이 과정에서 각 모달리티의 데이터를 결합하여 새로운 조인트 표현을 생성하고, 이를 바탕으로 다양한 AI 응용 프로그램에서 사용할 수 있습니다. 예를 들어, 물체 인식이나 소리 분리 작업에서 OmniBind를 활용하면, 기존의 모델들보다 더 높은 정확도를 달성할 수 있습니다.

또한, OmniBind는 경량 네트워크를 사용하여 학습 효율성을 극대화할 수 있습니다. 이를 통해, 대규모 데이터를 처음부터 학습할 필요 없이, 이미 존재하는 데이터를 효과적으로 활용하여 모델의 성능을 향상시킬 수 있습니다. 이러한 점에서 OmniBind는 다양한 AI 애플리케이션에서 매우 강력한 도구로 활용될 수 있습니다.

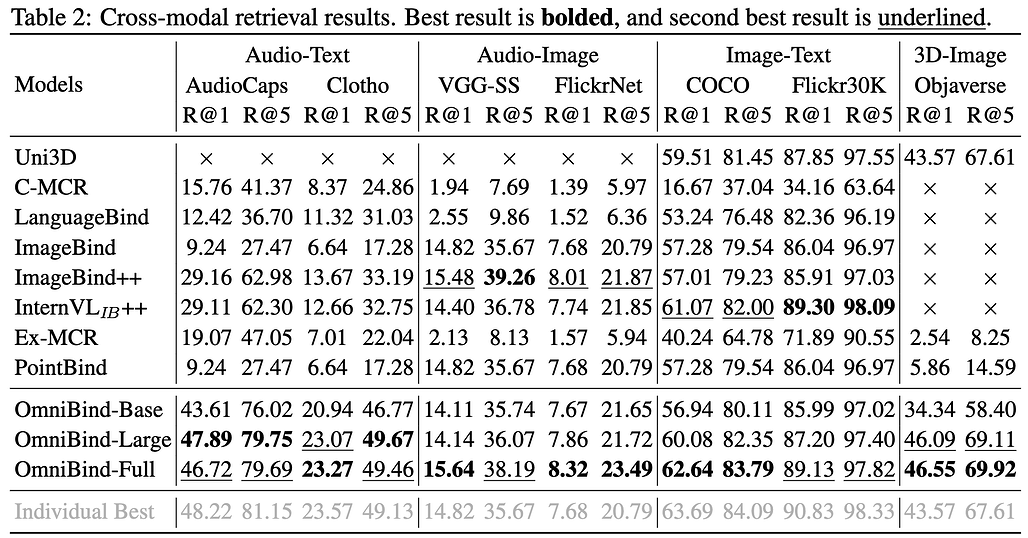

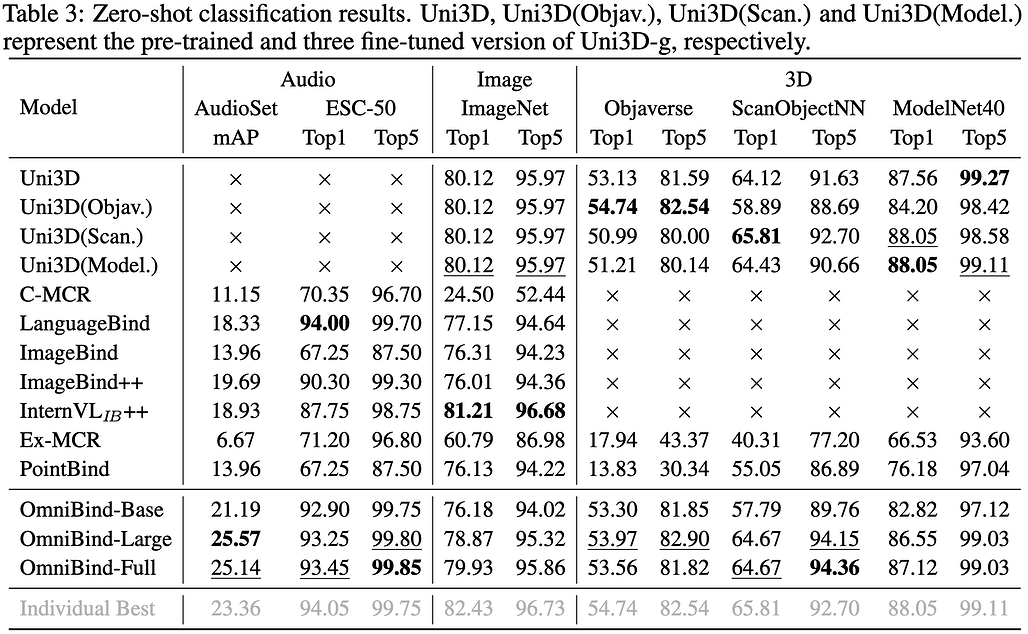

실험 결과

OmniBind는 다양한 유형의 데이터를 통합하고 처리하는 새로운 접근 방식을 제시하는 멀티모달 AI 분야에서 중요한 발전을 나타냅니다. 사전 학습된 전문가 모델을 결합하고 동적 라우팅 및 바인딩 메커니즘을 사용함으로써, OmniBind는 다양한 작업에서 높은 성능을 유지하면서도 학습 효율성을 극대화합니다. 그 다재다능함은 가상 비서와 디지털 미디어에서 증강 및 가상 현실 환경에 이르기까지 다양한 산업과 사용 사례에 적용할 수 있습니다.

정량적 결과 (Quantitative Results)

질적 결과 - 응용 사례 (Qualitative applications)

OmniBind 프로젝트 홈페이지

OmniBind 프로젝트 홈페이지

OmniBind 논문

OmniBind 논문

OmniBind GitHub 저장소

OmniBind GitHub 저장소

https://github.com/zehanwang01/OmniBind

OmniBind 모델 가중치

OmniBind 모델 가중치

이 글은 GPT 모델로 정리한 글을 바탕으로 한 것으로, 원문의 내용 또는 의도와 다르게 정리된 내용이 있을 수 있습니다. 관심있는 내용이시라면 원문도 함께 참고해주세요! 읽으시면서 어색하거나 잘못된 내용을 발견하시면 덧글로 알려주시기를 부탁드립니다. ![]()

파이토치 한국 사용자 모임

![]() 이 정리한 이 글이 유용하셨나요? 회원으로 가입하시면 주요 글들을 이메일

이 정리한 이 글이 유용하셨나요? 회원으로 가입하시면 주요 글들을 이메일![]() 로 보내드립니다! (기본은 Weekly지만 Daily로 변경도 가능합니다.)

로 보내드립니다! (기본은 Weekly지만 Daily로 변경도 가능합니다.)

![]() 아래

아래![]() 쪽에 좋아요

쪽에 좋아요![]() 를 눌러주시면 새로운 소식들을 정리하고 공유하는데 힘이 됩니다~

를 눌러주시면 새로운 소식들을 정리하고 공유하는데 힘이 됩니다~ ![]()