OpenAI의 AMA 소개

𝕏(Twitter)의 OpenAI Developers 계정(@OpenAIDevs)에서는 오늘 새벽 개발자들을 대상으로 AMA(Ask Me Anything) 세션을 진행했습니다. 이번 AMA에서는 OpenAI에 새로 공개한 o1 모델에 대한 질문들이 쏟아졌으며, 이를 Tibor Blanho(@btibor91)가 정리한 내용이 있어 소개합니다.

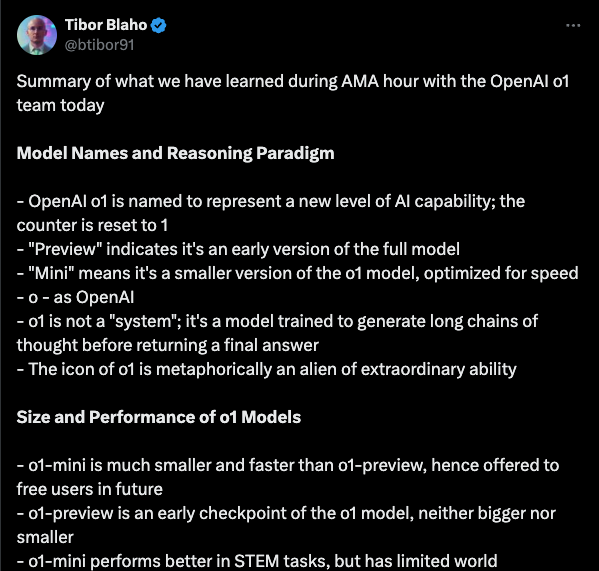

Tibor Blanho(@btibor91)가 정리한 OpenAI AMA 요약

모델 명명과 추론 패러다임

- OpenAI o1 명명: o는 OpenAI의 o를 따서 새로운 수준의 AI 능력을 나타내며, 카운터가 1로 리셋됨을 의미.

- "Preview"와 "Mini" 변형: "Preview"는 초기 버전을, "Mini"는 속도에 최적화된 버전을 의미.

- 모델 목적: 이전 모델과 달리, 최종 답변을 반환하기 전에 긴 사고의 연쇄를 생성하도록 학습됨.

- 아이콘 의미: 특별한 능력을 가진 외계인을 상징적으로 나타냄.

o1 모델의 크기와 성능

- o1-mini vs. o1-preview: o1-mini는 더 작고 빠르며 무료 사용자에게 제공될 예정이고, o1-preview는 초기 체크포인트.

- 성능 비교: o1-mini는 STEM 및 코드 관련 작업에서 뛰어난 성능을 보이며, 제한된 세계 지식을 가짐.

- 입력 토큰: GPT-4o와 동일한 토크나이저를 사용하여 계산됨.

입력 토큰 컨텍스트와 모델 능력

- 더 큰 입력 컨텍스트: 곧 제공될 예정으로, 입력을 나누지 않고 더 길고 개방적인 작업 수행 가능.

- 긴 사고의 연쇄: 최종 답변을 제공하기 전에 긴 추론 연쇄를 생성할 수 있음.

- 미래 탐색: 추론 중 추론을 멈추고 더 많은 컨텍스트를 추가할 수 있는 기능이 연구 중임.

도구, 기능, 그리고 향후 업데이트

- 도구 지원: 함수 호출, 코드 해석기, 브라우징 등의 도구 지원이 계획됨.

- 사용자 제어: 향후 업데이트에서 사고 시간 및 토큰 한도에 대한 제어가 가능해질 수 있음.

- 멀티모달(Multimodal) 기능: MMMU(Multimodal Multitask Unified)와 같은 작업에서 최첨단 성능을 목표로 함.

CoT(Chain of Thought, 사고의 연쇄) 추론

- 숨겨진 추론: 추론 과정에서 숨겨진 사고 연쇄를 생성하며, 이는 요약되어 사용자에게 표시됨.

- 프롬프트의 영향: 지시사항이 모델의 추론 스타일에 영향을 줄 수 있음.

- 강화 학습(Reinforcement Learning, RL): RL을 통해 CoT 성능이 향상되며, GPT-4o보다 고유한 강점을 제공.

API 및 사용 제한

- 사용 제한: o1-mini는 ChatGPT Plus 사용자에게 주당 50회 프롬프트 제한이 있으며, 더 많은 접근 계층이 계획됨.

- 프롬프트 캐싱: 요청된 기능이지만, 구현 일정은 아직 없음.

가격, 파인튜닝(Fine-Tuning), 그리고 확장

- 가격 트렌드: 1-2년마다 가격이 주기적으로 인하될 것으로 예상됨.

- 확장 도전: 연구와 엔지니어링 인재 부족이 병목이지만, 새로운 확장 패러다임이 큰 성과를 가져올 수 있음.

모델 개발 및 연구 통찰

- 학습 접근법: 높은 수준의 추론 성능을 달성하기 위해 강화 학습을 사용함.

- 창의적 및 횡단적 사고: 시, 암호 해독 등의 작업에서 강력한 성능을 보임.

- 내부 응용 프로그램: GitHub 봇 생성 및 자체 퀴즈를 통해 추론 능력을 테스트함.

프롬프트 기법과 모범 사례

- 프롬프트 최적화: 효과적인 프롬프트는 에지 케이스와 추론 스타일을 제공하는 방식임.

- 컨텍스트 민감도: 관련 컨텍스트를 포함하면 성능이 향상되며, 관련 없는 정보는 추론을 방해할 수 있음.

일반 피드백과 향후 개선 사항

- 초기 사용 제한: 초기 테스트로 인해 설정되었으나 점차 확대될 예정.

- 지속적인 개선: 지연 시간과 추론 시간을 줄이기 위해 작업 중.

놀라운 모델 능력

- 철학적 추론: "삶이란 무엇인가?"와 같은 복잡한 철학적 질문을 처리할 수 있음.

- 창의적 응용: 자체 퀴즈를 통해 추론 능력을 측정하는 등 추상적 작업에 강함.

Tibor Blanho(@btibor91)의 원문 트윗 보기

Tibor Blanho(@btibor91)의 원문 트윗 보기

https://x.com/btibor91/status/1834686946846597281

이 글은 GPT 모델로 정리한 글을 바탕으로 한 것으로, 원문의 내용 또는 의도와 다르게 정리된 내용이 있을 수 있습니다. 관심있는 내용이시라면 원문도 함께 참고해주세요! 읽으시면서 어색하거나 잘못된 내용을 발견하시면 덧글로 알려주시기를 부탁드립니다. ![]()

파이토치 한국 사용자 모임

![]() 이 정리한 이 글이 유용하셨나요? 회원으로 가입하시면 주요 글들을 이메일

이 정리한 이 글이 유용하셨나요? 회원으로 가입하시면 주요 글들을 이메일![]() 로 보내드립니다! (기본은 Weekly지만 Daily로 변경도 가능합니다.)

로 보내드립니다! (기본은 Weekly지만 Daily로 변경도 가능합니다.)

![]() 아래

아래![]() 쪽에 좋아요

쪽에 좋아요![]() 를 눌러주시면 새로운 소식들을 정리하고 공유하는데 힘이 됩니다~

를 눌러주시면 새로운 소식들을 정리하고 공유하는데 힘이 됩니다~ ![]()