TileRT 소개

TileRT는 대규모 언어 모델(LLM)의 추론 속도를 극대화하기 위해 설계된 실험적인 런타임 프로젝트입니다. 현재 대부분의 LLM 추론 시스템은 처리량(Throughput)을 높이는 데 집중하고 있습니다. 즉, 많은 사용자의 요청을 동시에 처리하기 위해 '배치(Batch)' 처리를 최적화하는 방식입니다. 하지만 이러한 방식은 고빈도 매매(HFT), 실시간 의사결정, 인터랙티브 AI, 장기 실행 에이전트(Long-running Agents)와 같이 단일 요청에 대한 **즉각적인 응답 속도(Latency)**가 중요한 시나리오에서는 최적의 성능을 내지 못하는 경우가 많습니다.

TileRT는 이러한 기존 시스템의 한계를 극복하고, 초저지연(Ultra-Low-Latency) 환경을 구축하는 것을 목표로 합니다. 수천억 개의 파라미터를 가진 거대 모델이라 할지라도 밀리초(ms) 단위의 토큰 생성 속도(TPOT)를 달성하여, 사용자가 지연을 거의 느끼지 못하는 수준의 반응성을 제공하고자 합니다.

이 프로젝트는 컴파일러 기반의 접근 방식을 사용하여 LLM 연산자를 세밀한 '타일(Tile)' 단위의 작업으로 분해합니다. 이를 통해 컴퓨팅, I/O, 통신 작업을 고도로 중첩(Overlap)시켜 하드웨어의 유휴 시간(Idle time)을 최소화하고 GPU와 같은 가속기의 성능을 극한까지 끌어올립니다. 현재 tile-ai 조직에서 개발 중이며, 향후 TileLang 및 TileScale과 같은 관련 기술들과 통합될 예정입니다.

vLLM 및 SGLang과의 비교

TileRT는 기존의 대표적인 LLM 서빙 프레임워크들과 설계 철학에서 큰 차이를 보입니다. 예를 들어, vLLM이나 SGLang과 같은 시스템은 주로 높은 처리량(High Throughput) 을 달성하는 것을 목표로 설계되었습니다. Continuous Batching이나 PagedAttention과 같은 기술을 사용하여 메모리 효율성을 높이고, 한 번에 많은 요청을 처리하여 GPU 활용률을 극대화합니다. 이는 챗봇 서비스와 같이 다수의 동시 접속자가 있는 환경에 적합합니다.

이에 반해, TileRT는 지연 시간(Latency), 특히 배치 크기가 작은 경우(Small Batch Size)의 응답 속도에 집중합니다. 단일 요청이나 적은 수의 요청을 처리할 때도 하드웨어 리소스를 최대한 활용하여 가장 빠른 속도로 결과를 반환하도록 최적화되어 있습니다. 이는 코딩 어시스턴트나 실시간 에이전트와 같이 사용자와의 즉각적인 상호작용이 필수적인 분야에서 큰 강점을 가집니다.

TileRT의 주요 특징

TileRT는 단순히 모델을 실행하는 것을 넘어, 하드웨어 레벨에서의 실행 효율성을 높이기 위해 컴파일러 기술과 런타임 엔진을 결합한 독창적인 아키텍처를 가지고 있습니다.

타일 레벨(Tile-Level) 런타임 엔진

TileRT의 핵심은 타일(Tile) 단위의 실행 전략입니다. 거대한 행렬 연산이나 신경망 레이어를 한 번에 처리하는 대신, 이를 작은 타일 단위로 쪼개어 처리합니다.

-

세밀한 작업 분해: 컴파일러 주도 접근 방식을 통해 LLM 연산자를 매우 작은 단위(Fine-grained tasks)로 분해합니다.

-

스케줄링 최적화: 분해된 작업들은 런타임 엔진에 의해 재스케줄링됩니다. 이때 계산(Compute), 데이터 입출력(I/O), 그리고 장치 간 통신(Communication)을 서로 겹치게(Overlap) 실행하여, 어느 한 자원이 작업을 기다리며 노는 시간을 최소화합니다.

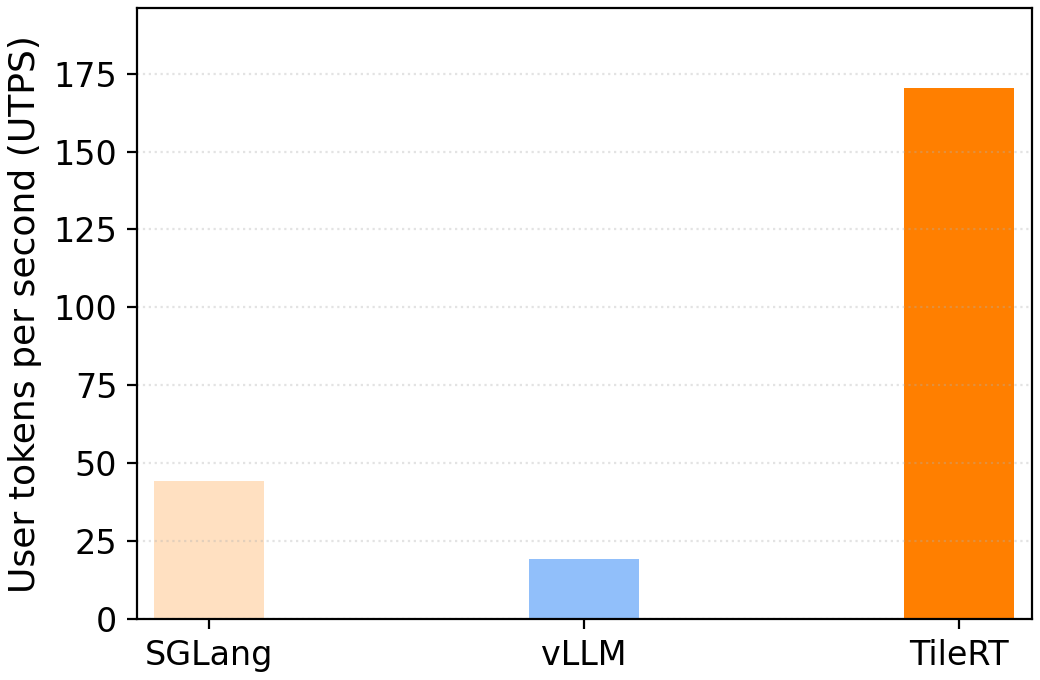

빠른 벤치마크 성능

TileRT 저장소에 공개된 벤치마크 결과에 따르면, TileRT는 최신 하드웨어 환경에서 기존 시스템 대비 월등한 성능을 보여줍니다.

-

테스트 환경: NVIDIA B200 GPU 8개를 사용한 환경에서 배치 사이즈 1로 설정하여 테스트를 진행했습니다.

-

대상 모델: DeepSeek-V3.2-Exp 모델을 양자화(Quantization)나 증류(Distillation) 없이 원본 그대로 사용하여 평가했습니다.

즉, TileRT는 vLLM이나 SGLang 대비 훨씬 빠른 토큰 생성 속도를 기록하며, 특히 대규모 모델의 실시간 추론 가능성을 입증했습니다.

Tile-AI 생태계 통합

TileRT는 단독으로 작동하기보다 tile-ai 생태계의 다른 도구들과 시너지를 낼 예정입니다. 예를 들어, TileLang과 TileScale을 살펴보면 다음과 같습니다:

- TileLang: 고성능 GPU 커널 개발을 위한 도메인 특화 언어(DSL)로, TileRT의 컴파일러 기술이 여기에 통합될 예정입니다.

- TileScale: 다양한 규모의 AI 연산을 위한 확장 기술로, TileRT의 최적화 기법이 적용됩니다.

설치 및 사용 (실험적 단계)

현재 TileRT는 실험적인 단계(Experimental Project)에 있으며 빠르게 발전하고 있습니다. 현재 제공하고 있는 미리보기 빌드(Preview build)는 B200 GPU 8장을 지원하는 환경만을 고려하고 있습니다. 또한, 상용 환경에서 사용하는 것은 권장하지 않습니다.

-

설치: 프로젝트는

PyPI배포를 준비 중이며,Dockerfile을 통해 컨테이너 환경에서 빌드하여 테스트해 볼 수 있습니다. Docker 기반 이미지를 받아 사용하는 것은 GitHub 저장소를 참고해주세요. -

사용: 구체적인 Python API 예제는 저장소의 업데이트를 통해 지속적으로 공개될 예정이며, 현재는 소스 코드를 직접 빌드하여 연구 목적으로 활용하는 것이 권장됩니다.

라이선스

TileRT 프로젝트는 MIT License 하에 배포되고 있습니다. 상업적 이용, 수정, 배포가 자유로운 오픈 소스 라이선스입니다.

TileRT 공식 GitHub 저장소

TileRT 공식 GitHub 저장소

https://github.com/tile-ai/TileRT

이 글은 GPT 모델로 정리한 글을 바탕으로 한 것으로, 원문의 내용 또는 의도와 다르게 정리된 내용이 있을 수 있습니다. 관심있는 내용이시라면 원문도 함께 참고해주세요! 읽으시면서 어색하거나 잘못된 내용을 발견하시면 덧글로 알려주시기를 부탁드립니다. ![]()

파이토치 한국 사용자 모임

![]() 이 정리한 이 글이 유용하셨나요? 회원으로 가입하시면 주요 글들을 이메일

이 정리한 이 글이 유용하셨나요? 회원으로 가입하시면 주요 글들을 이메일![]() 로 보내드립니다! (기본은 Weekly지만 Daily로 변경도 가능합니다.)

로 보내드립니다! (기본은 Weekly지만 Daily로 변경도 가능합니다.)

![]() 아래

아래![]() 쪽에 좋아요

쪽에 좋아요![]() 를 눌러주시면 새로운 소식들을 정리하고 공유하는데 힘이 됩니다~

를 눌러주시면 새로운 소식들을 정리하고 공유하는데 힘이 됩니다~ ![]()