Claude Code RLM 소개

Claude Code RLM은 Brainqub3가 구현한 프로젝트로, Recursive Language Models (RLM) 패턴을 Anthropic의 Claude Code 프레임워크 내에서 사용할 수 있도록 설계된 스캐폴딩(Scaffold)입니다. 이 프로젝트의 핵심은 단일 LLM이 한 번에 처리하기 힘든 방대한 양의 데이터나 문서를 '재귀적'인 방식으로 나누어 처리하고 요약하여, 최종적으로 모델의 물리적인 컨텍스트 윈도우(Context Window) 한계를 수십 배 이상 뛰어넘는 결과를 도출하는 데 있습니다.

이 기술이 중요한 이유는 현대의 소프트웨어 개발 환경이 수만 라인의 코드와 수백 페이지의 문서를 포함하기 때문입니다. 기존에는 RAG(Retrieval-Augmented Generation)를 통해 필요한 부분만 검색해 왔다면, RLM 방식은 전체 맥락을 유지하면서도 세부 사항을 놓치지 않도록 구조적으로 정보를 계층화합니다. 특히 MIT CSAIL의 최신 연구(arXiv:2512.24601)를 바탕으로 구현되어, 이론적 토대와 실용성을 모두 갖춘 도구로 평가받고 있습니다.

향후 이를 통해 긴 로그 파일 분석, 대규모 레포지토리의 전체 구조 파악, 그리고 복잡한 기술 사양서 기반의 코드 생성 등 기존 LLM 인터페이스로는 불가능했던 작업들을 수행할 수 있게 될 것으로 기대합니다. 또한, 단순히 정보를 찾는 수준을 넘어, 거대한 환경 자체를 LLM이 이해하고 조작할 수 있는 환경을 제공하는 것을 목표로 합니다.

![]() RLM(Recursive Language Model)에 대한 더 상세한 내용은 다음 게시물을 참고해주세요:

RLM(Recursive Language Model)에 대한 더 상세한 내용은 다음 게시물을 참고해주세요:

RLM vs. RAG 방식 비교

일반적으로 긴 문서를 처리하기 위해서 사용하는 RAG(Retrieval-Augmented Generation) 기법과 RLM 방식을 비교하면, RAG(Retrieval-Augmented Generation) 는 질문과 관련된 파편화된 정보 조각들을 데이터베이스에서 검색하여 컨텍스트에 주입합니다. 전체적인 흐름이나 논리적 구조를 파악하는 데 한계가 있습니다.

이에 비해, RLM(Recursive Language Models) 방식은 전체 문서를 환경(Environment)으로 간주합니다. Root LLM이 전체 작업을 지휘하고, 하위 LLM(Sub-LLM)들이 문서의 각 부분을 재귀적으로 분석하여 결과를 상위로 보고합니다. 마치 팀장이 팀원들에게 업무를 분담시키고 보고서를 취합하는 구조와 유사합니다.

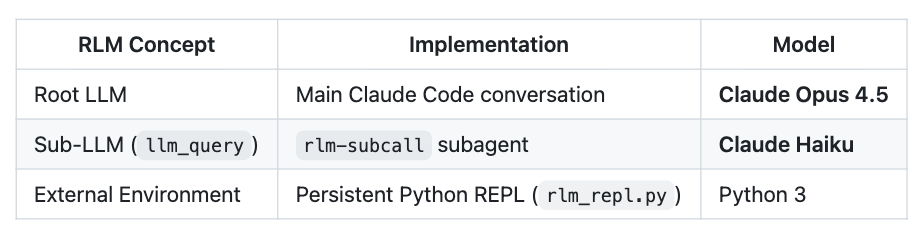

이러한 재귀적 호출 방식을 통해, RLM은 단일 모델의 컨텍스트 한계보다 최대 100배 더 큰 입력을 처리할 수 있습니다. 특히, Claude Code RLM에서는 Root LM으로는 Claude 4.5 Opus를, Sub LM으로는 Haiku 모델을 조합하여 비용 효율성과 정확도를 동시에 만족시킬 수 있도록 구성하였습니다.

Claude Code RLM의 주요 특징

claude_code_RLM은 단순한 스크립트 모음이 아니라, Claude Code의 기능을 확장하는 Skill과 Agent의 결합체입니다.

재귀적 언어 모델(RLM, Recursive Language Models) 아키텍처

RLM 시스템은 "Root-Sub"의 Top-Down 구조를 채택하여 효율적인 연산을 수행합니다:

-

Root LM (Opus 4.5 등): 전체적인 문제 해결 전략을 세우고 하위 에이전트들에게 작업을 할당합니다. 최종 결과를 종합하여 사용자에게 전달하는 역할을 합니다.

-

Sub-LM (Haiku 등): Root LM이 분할한 텍스트 청크(Chunk)를 빠르게 분석하고 요약하는 실무 역할을 수행합니다. 상대적으로 저렴하고 빠른 모델을 사용하여 전체 비용을 절감합니다.

Claude Code RLM의 주요 구성

Claude Code RLM은 RLM 논문의 구조를 따라 다음과 같이 구성하였습니다:

-

Skill (

/rlm): Claude Code CLI 내에서 실행할 수 있는 슬래시 명령어입니다. 사용자가 경로를 입력하면 RLM 워크플로우를 시작합니다. -

Sub Agent (

rlm-subcall): 하위 작업을 수행하기 위한 전용 에이전트입니다. -

Persistent Python REPL (

rlm_repl.py): 호출 간 상태를 유지하는 파이썬 실행 환경입니다. 대규모 데이터를 메모리에 올리고 효율적으로 검색, 분할, 관리하는 유틸리티를 제공합니다.

데이터 처리 프로세스

-

초기화: 사용자가 대상 파일 경로와 쿼리를 제공하면 REPL 세션이 시작됩니다.

-

청킹(Chunking): 문서의 성격에 따라 고정 크기, 의미론적(Semantic), 또는 병렬 청킹 전략을 사용하여 데이터를 나눕니다.

-

위임: Root 모델이 필요한 정보가 담긴 청크를 식별하여 Sub-LLM에게 분석을 요청합니다.

-

합성: 하위 모델들이 반환한 분석 결과들을 Root 모델이 논리적으로 엮어 최종 답변을 생성합니다.

Claude Code RLM 설치 및 사용법

Claude Code RLM은 Claude Code 동작하므로, 기본적으로 Claude Code가 설치되어 있어야 합니다.

# 1. 저장소 복제(clone)

git clone https://github.com/brainqub3/claude_code_RLM.git

cd claude_code_RLM

# 2. Claude Code 실행

claude

# 3. RLM 스킬 실행

/rlm

# 4. 이후 단계 작업 및 진행

# 프롬프트에 따라 컨텍스트 파일 경로와 질문 입력 후 실행

주의

: Claude Code RLM 프로젝트는 실험적인 구현체이며 프로덕션 환경에서 직접 사용하기보다는 연구 및 복잡한 분석 작업 보조용으로 권장됩니다. 특히 'Dangerous Mode' 사용 시 파일 수정 권한이 부여되므로 격리된 작업 디렉토리에서 실행하는 것이 안전합니다.

라이선스

Claude Code RLM 프로젝트는 MIT License로 공개 및 배포되고 있습니다.

Claude Code RLM 프로젝트 GitHub 저장소

Claude Code RLM 프로젝트 GitHub 저장소

RLM(Recursive Language Model) 논문 및 소개 글

RLM(Recursive Language Model) 논문 및 소개 글

이 글은 GPT 모델로 정리한 글을 바탕으로 한 것으로, 원문의 내용 또는 의도와 다르게 정리된 내용이 있을 수 있습니다. 관심있는 내용이시라면 원문도 함께 참고해주세요! 읽으시면서 어색하거나 잘못된 내용을 발견하시면 덧글로 알려주시기를 부탁드립니다. ![]()

파이토치 한국 사용자 모임

![]() 이 정리한 이 글이 유용하셨나요? 회원으로 가입하시면 주요 글들을 이메일

이 정리한 이 글이 유용하셨나요? 회원으로 가입하시면 주요 글들을 이메일![]() 로 보내드립니다! (기본은 Weekly지만 Daily로 변경도 가능합니다.)

로 보내드립니다! (기본은 Weekly지만 Daily로 변경도 가능합니다.)

![]() 아래

아래![]() 쪽에 좋아요

쪽에 좋아요![]() 를 눌러주시면 새로운 소식들을 정리하고 공유하는데 힘이 됩니다~

를 눌러주시면 새로운 소식들을 정리하고 공유하는데 힘이 됩니다~ ![]()