OpenClaw-RL 소개

2026년 초부터 자율 에이전트 시장은 컴퓨터의 운영체제 제어권을 가지고 직접 업무를 수행하는 오픈소스 프로젝트인 OpenClaw의 등장으로 큰 변화를 맞이했습니다. 기존의 대화형 인공지능이 텍스트 형태의 답변만 제공하던 것과 달리, OpenClaw는 사용자의 로컬 환경에서 파일을 수정하거나 브라우저를 탐색하는 등 실질적인 작업을 수행하며 높은 활용도를 입증했습니다. 하지만 이러한 에이전트들은 매일 동일한 성능과 행동 양식을 유지하는 정적인 모델 구조라는 한계를 지니고 있었습니다. 즉, 사용자가 반복적으로 자신의 작업 스타일이나 선호도를 지시해야만 하는 불편함이 존재했습니다.

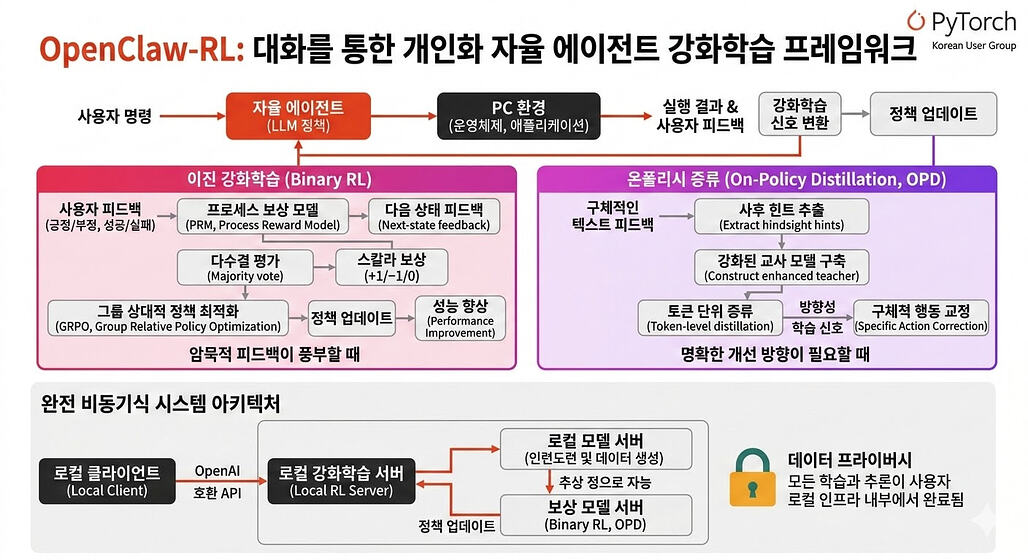

프린스턴 대학교의 AI 연구 그룹인 Gen-Verse는 이러한 정적 에이전트의 한계를 극복하고자 OpenClaw-RL 프로젝트를 공개했습니다. OpenClaw-RL은 Gen-Verse의 Open-AgentRL 프레임워크을 기반으로 구축된 완전 비동기식 강화학습 프레임워크로, 사용자와 에이전트 간의 일상적인 대화를 실시간 학습 신호로 변환하여 모델을 지속적으로 업데이트합니다. 사용자가 에이전트에게 칭찬을 하거나 구체적인 수정 지시를 내리면, 백그라운드에서 모델이 스스로 가중치를 조정하여 사용자의 작업 방식에 맞게 진화하게 됩니다.

OpenClaw-RL의 가장 중요한 핵심 가치는 외부 API에 의존하지 않고 사용자의 인프라 내부에서 모든 학습과 추론이 이루어진다는 점입니다. 데이터가 외부 서버로 전송되지 않기 때문에 민감한 개인정보나 사내 기밀이 유출될 위험이 완벽히 차단됩니다. 결과적으로 OpenClaw-RL은 데이터 프라이버시를 보장하면서도 개인화된 맞춤형 자율 에이전트를 구축할 수 있는 강력한 솔루션을 제공합니다.

OpenClaw-RL vs. 기존 정적 에이전트와의 비교

기존의 OpenClaw 모델은 고정된 가중치를 가지고 있어 어제 사용한 모델과 오늘 사용하는 모델이 정확히 동일한 방식으로 동작합니다. 사용자의 이전 피드백을 반영하기 위해서는 프롬프트 엔지니어링을 통해 컨텍스트 윈도우 내에 과거의 기억을 주입해야만 했으며, 이는 컨텍스트 길이의 한계와 추론 비용 증가라는 문제를 동반했습니다.

반면, OpenClaw-RL은 프롬프트에 의존하는 대신 강화학습을 통해 모델의 가중치 자체를 업데이트합니다. 에이전트가 서비스를 제공하는 동안 중단 없이 백그라운드에서 궤적을 수집하고 학습을 진행하므로, 시간이 지날수록 사용자의 명시적인 지시 없이도 선호도에 정확히 부합하는 방향으로 행동을 교정하는 차별화된 능력을 보여줍니다.

OpenClaw-RL의 구조: 완전 비동기식 시스템 아키텍처

OpenClaw-RL은 시스템의 응답 속도 저하를 방지하기 위해 4개의 독립적인 구성 요소가 서로를 차단하지 않고 동작하는 완전 비동기식 아키텍처를 채택했습니다. 사용자의 디바이스에서 실행되는 클라이언트 어시스턴트는 30000번 포트를 통해 무선으로 통신하며, OpenAI 호환 API를 제공하는 로컬 모델 서버와 데이터를 주고받습니다. 이 과정에서 사용자의 요청을 처리함과 동시에, 생성된 대화 궤적과 피드백 데이터는 즉각적으로 프로세스 보상 모델 서버로 전송됩니다.

프로세스 보상 모델 서버는 사용자의 대화 흐름을 분석하여 백그라운드에서 궤적을 평가하고 점수를 매기는 역할을 수행합니다. 사용자가 프론트엔드에서 에이전트와 원활하게 대화를 이어가는 동안, 서버의 이면에서는 평가된 데이터를 바탕으로 지속적인 정책 업데이트가 이루어집니다. 이러한 병렬 처리 구조 덕분에 무거운 강화학습 연산이 진행되는 중에도 에이전트의 추론 성능이나 대화의 지연 시간에 영향을 미치지 않으며, 실시간으로 서비스가 제공되는 환경에서도 끊임없는 자가 발전이 가능합니다.

OpenClaw-RL의 대화 기반 두 가지 핵심 강화학습 패러다임: GRPO & OPD

OpenClaw-RL은 사용자의 자연스러운 피드백을 학습 데이터로 변환하기 위해 두 가지 고도화된 학습 패러다임을 지원합니다.

첫 번째는 그룹 상대적 정책 최적화 기법을 활용한 이진 강화학습 방식(Binary RL, GRPO) 입니다. 이 방식은 사용자가 에이전트의 답변에 대해 단순히 긍정적이거나 부정적인 반응을 보일 때 주로 동작합니다. 시스템은 사용자의 다음 메시지를 이전 답변에 대한 암묵적인 평가로 간주하고, 프로세스 보상 모델이 이를 긍정, 부정, 중립 등으로 분류하여 스칼라 형태의 보상 값을 산출합니다. 이렇게 도출된 보상 값은 전체 응답 토큰에 브로드캐스트되어 정책을 최적화하며, 별도의 수동 데이터 라벨링 없이도 자연스러운 대화 흐름 속에서 모델을 안정적으로 개선합니다.

두 번째는 정책 기반 증류 기법(On-Policy Distillation, OPD) 으로, 사용자가 구체적인 힌트나 방향성을 제시할 때 동작하는 더욱 강력한 학습 방법입니다. 예를 들어, 사용자가 특정 파일을 먼저 확인했어야 한다고 지적하면, 판단 모델이 해당 피드백에서 텍스트 형태의 사후 힌트를 추출합니다. 이 힌트는 기존 프롬프트에 추가되어 향상된 교사 프롬프트를 생성하고, 교사 모델과 학생 모델 간의 토큰 수준 로그 확률 차이를 계산하여 방향성 있는 학습 신호를 만들어냅니다. 이는 단순한 점수 기반의 보상보다 훨씬 풍부한 정보를 담고 있어, 모델이 정확히 무엇을 어떻게 수정해야 하는지 직관적으로 학습할 수 있도록 돕습니다.

| 방법론 (Method) | 학습 신호 유형 (Signal Type) | 동작 원리 (How It Works) | 활용 시기 (When to Use) |

|---|---|---|---|

| 이진 강화학습 (Binary RL) | 스칼라 값 (+1 / -1 / 0) | 프로세스 보상 모델(PRM)이 다음 상태의 피드백을 다수결 방식으로 평가하여 응답 품질을 판단한 후, 그룹 상대적 정책 최적화(GRPO)를 통해 모델을 업데이트합니다. | '좋아요/싫어요'와 같은 평가나 환경 내 작업의 성공 및 실패 여부 등, 암묵적인 피드백 데이터가 풍부하게 수집될 때 적용합니다. |

| 정책 기반 증류 (On-Policy Distillation, OPD) | 토큰 단위의 방향성 신호 | 다음 상태의 피드백에서 사후 힌트(Hindsight hints)를 추출하여 강화된 교사 모델을 구성하고, 이를 통해 토큰 수준의 지식 증류를 수행하여 구체적인 교정 신호를 생성합니다. | 사용자의 구체적이고 풍부한 텍스트 피드백이 제공되며, 모델의 행동 패턴에 대한 명확한 방향성 개선이 필요할 때 적용합니다. |

클라이언트 연동 및 환경 설정 방법

OpenClaw-RL을 로컬 환경에 적용하는 과정은 매우 직관적으로 설계되었습니다. 사용자는 기존에 사용하던 OpenClaw 클라이언트의 설정 파일에서 엔드포인트를 로컬 강화학습 서버로 변경하기만 하면 됩니다. 모델 서버가 자체적으로 OpenAI 호환 인터페이스를 제공하기 때문에 복잡한 연동 작업 없이 포트 번호와 로컬 API 키만 지정하면 즉시 연결이 완료됩니다.

{

"openai": {

"base_url": "http://localhost:30000/v1",

"api_key": "sk-your-local-key"

}

}

위의 설정 파일을 적용하고 클라이언트를 재시작하면, 에이전트는 사용자와의 모든 대화 내역을 로컬 모델 서버로 전송하기 시작합니다. 이때 전송된 데이터는 외부 네트워크를 타지 않고 로컬 인프라 내부에서만 처리되며, 백그라운드 학습 파이프라인이 자동으로 가동되어 사용자의 피드백을 흡수합니다. 초기 설정 이후에는 사용자가 평소처럼 업무 지시를 내리고 자연스럽게 대화하는 것만으로도 에이전트의 지속적인 진화 과정을 경험할 수 있습니다.

OpenClaw-RL은 Slime을 기반 강화학습 프레임워크(Base RL Framework)로 사용하고 있습니다. 환경 설정과 관련한 상세한 내용은 Slime 프레임워크 또는 OpenClaw-RL 저장소의 문서를 참고해주세요.

라이선스

OpenClaw-RL 프로젝트는 MIT 라이선스로 공개 및 배포되고 있습니다.

OpenClaw-RL 프로젝트 GitHub 저장소

OpenClaw-RL 프로젝트 GitHub 저장소

커뮤니티에서 제작한 OpenClaw-RL 튜토리얼 영상 2편

커뮤니티에서 제작한 OpenClaw-RL 튜토리얼 영상 2편

더 읽어보기

-

Open-AgentRL: LLM 에이전트 강화를 위한 통합 오픈소스 프레임워크 (feat. RLAnything & DemyAgent)

-

slime: RL 기반의 LLM 사후학습을 위한 SGLang 기반의 RL Scaling 프레임워크 (feat. Ziphu AI & THUDM)

이 글은 GPT 모델로 정리한 글을 바탕으로 한 것으로, 원문의 내용 또는 의도와 다르게 정리된 내용이 있을 수 있습니다. 관심있는 내용이시라면 원문도 함께 참고해주세요! 읽으시면서 어색하거나 잘못된 내용을 발견하시면 덧글로 알려주시기를 부탁드립니다. ![]()

파이토치 한국 사용자 모임

![]() 이 정리한 이 글이 유용하셨나요? 회원으로 가입하시면 주요 글들을 이메일

이 정리한 이 글이 유용하셨나요? 회원으로 가입하시면 주요 글들을 이메일![]() 로 보내드립니다! (기본은 Weekly지만 Daily로 변경도 가능합니다.)

로 보내드립니다! (기본은 Weekly지만 Daily로 변경도 가능합니다.)

![]() 아래

아래![]() 쪽에 좋아요

쪽에 좋아요![]() 를 눌러주시면 새로운 소식들을 정리하고 공유하는데 힘이 됩니다~

를 눌러주시면 새로운 소식들을 정리하고 공유하는데 힘이 됩니다~ ![]()