R1-V 모델 소개

R1-V는 Deep Agent 팀이 공개한 모델로, RLVR(Reinforcement Learning with Verifiable Rewards) 기법을 활용하여 시각-언어 모델(VLM, Vision-Language Model)의 일반화 능력을 극대화하는 연구입니다. R1-V는 이미지 내 사물 개수 세기(counting)와 같은 시각적 추론을 학습하도록 설계되었으며, 기존 학습 방식보다 적은 데이터와 비용으로 강력한 성능을 보이는 것이 특징입니다. 특히, $3 미만의 비용으로 훈련하여 대형 모델을 능가하는 성능을 보여주었다는 점이 흥미롭습니다.

이 R1-V 연구의 주요 특징은 다음과 같습니다:

-

강화학습 기반 RLVR 기법이 기존 CoT-SFT(Chain-of-Thought Supervised Fine-Tuning)보다 효과적이며, OOD(Out-of-Distribution) 일반화 성능도 뛰어남

-

단 2B 크기의 모델로 72B 모델을 초과하는 성능을 보였으며, 단 100 스텝 학습만으로도 OOD 테스트에서 우수한 결과를 보였습니다.

-

8개의 A100 GPU에서 30분(약 $2.62) 동안 학습했다는 점에서 고효율 학습 기법으로도 주목할 만합니다.

-

학습 과정에서는 CLEVR-70K 데이터셋을 사용했으며, 이를 기반으로 모델이 일반화된 시각적 개념을 학습하도록 유도했습니다.

RLVR (Reinforcement Learning with Verifiable Rewards) 기법 소개

Reinforcement Learning with Verifiable Rewards (RLVR)는 강화학습(RL) 기반의 학습 기법으로, 검증 가능한 보상(Verifiable Rewards)을 활용하여 모델을 최적화하는 방법입니다.

기존의 RL 방식에서는 보상 함수(Reward Function)를 사람이 설계하는 경우가 많았으나, RLVR은 객관적으로 검증할 수 있는 정량적 기준을 보상으로 활용하여 학습 효율성과 일반화 성능을 향상시키는 것이 특징입니다.

-

검증 가능한 보상 시스템(Verifiable Rewards System): RLVR은 객관적인 기준으로 모델의 출력을 평가하여 학습 보상을 부여합니다. 예를 들어, 시각적 개수 세기(counting) 문제에서는 정답과 비교하여 정확성을 평가하고, 그에 따라 모델이 보상을 받는 형태입니다.

-

기존 강화학습(RL) 방식 대비 안정적인 학습: 기존 RL 방식은 보상 함수의 설정이 어렵고 불안정한 결과를 초래할 가능성이 높습니다. 하지만, RLVR은 검증 가능한 기준을 기반으로 보상을 제공하여 안정적이고 신뢰성 높은 학습이 가능합니다.

-

OOD(Out-of-Distribution) 일반화 성능 향상: RLVR을 사용한 R1-V 실험에서, 작은 모델(2B)이 72B 모델보다 OOD 성능이 뛰어난 것으로 나타났습니다. 이는 모델이 특정 학습 데이터에 과적합(overfitting)되지 않고 일반적인 개념을 학습할 수 있도록 유도하기 때문으로 보입니다.

R1-V 성능

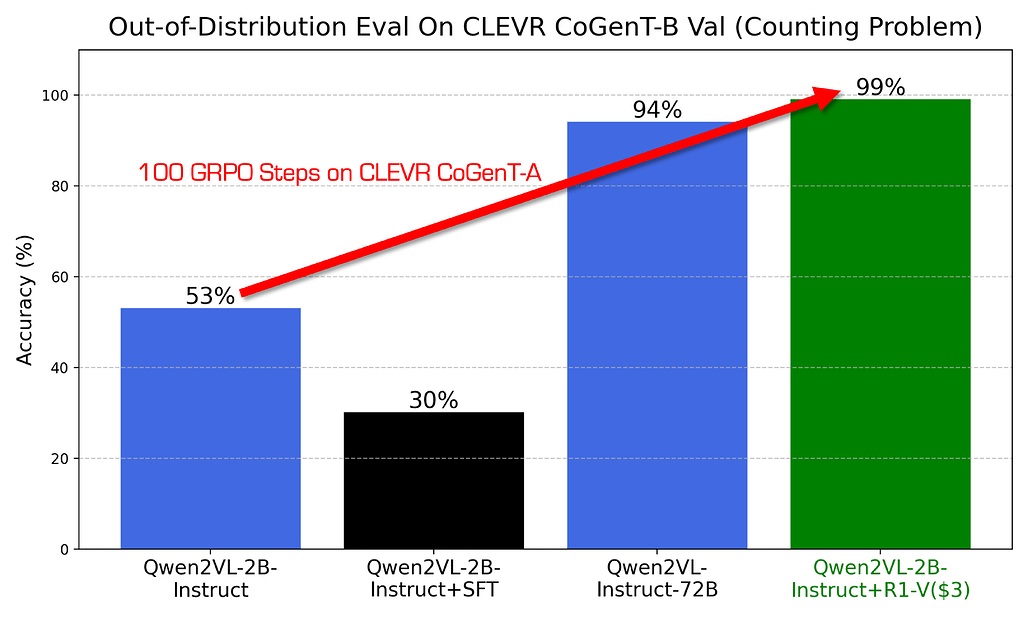

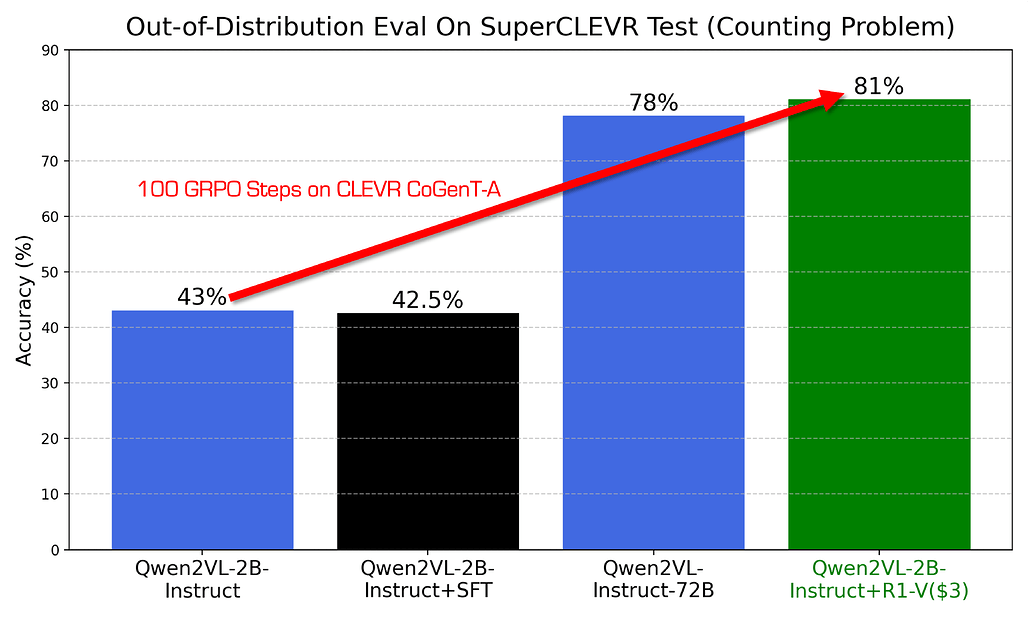

R1-V를 적용한 2B 모델은 CLEVR CoGenT-B 데이터셋에서 99%의 정확도를 기록하며, 기존 72B 모델의 94% 성능을 넘어섰다. SuperCLEVR 데이터셋에서도 R1-V 적용 2B 모델은 81%의 성능을 기록하며, 72B 모델(78%)보다 높은 결과를 보였습니다. 특히, 기존 2B 모델의 성능이 43% 수준이었던 것을 고려하면, R1-V를 적용한 후 OOD 성능이 획기적으로 향상된 것을 확인할 수 있다습니다.

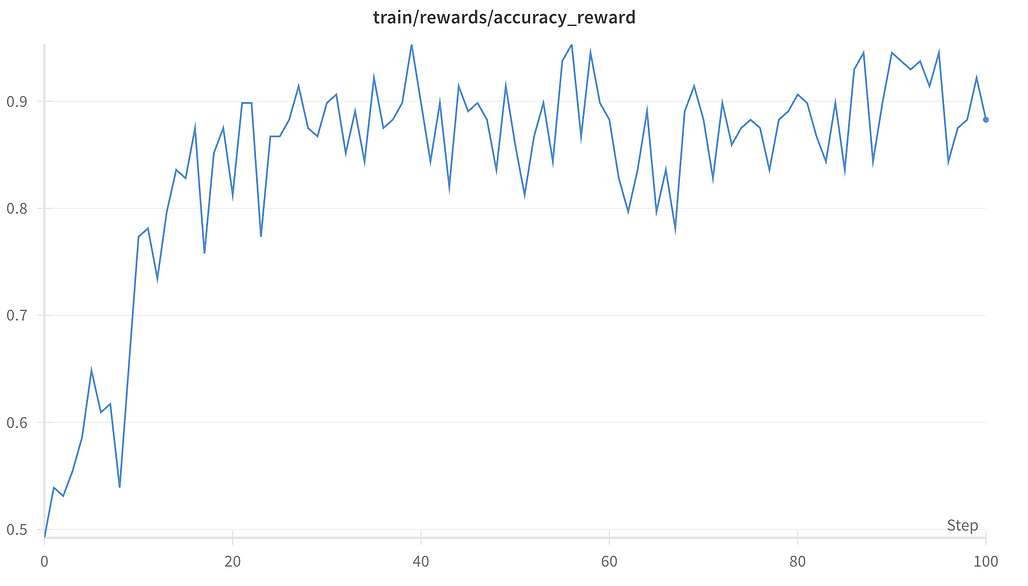

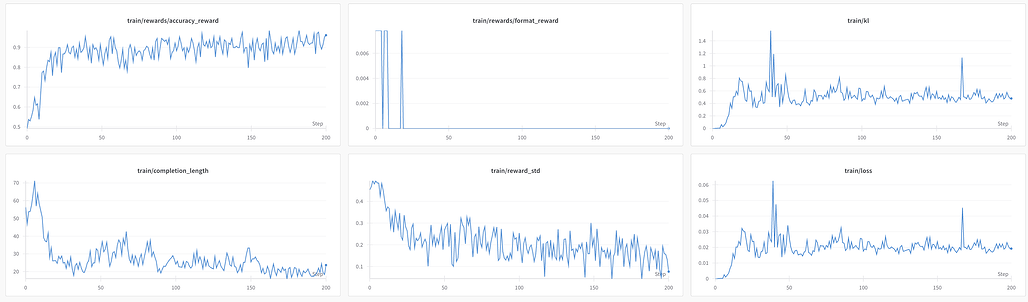

R1-V의 강점은 학습 과정에서도 두드러졌습니다. 학습 초반에는 정확도 보상(accuracy reward)이 낮았지만, 불과 몇 스텝 만에 90% 이상으로 급격히 상승했습니다. 또한, 100 스텝 이내에서 이미 최적의 성능을 달성했으며, 학습이 진행될수록 보상의 변동성이 줄어들며 안정적인 학습이 이루어졌습니다. 전체적으로 Loss 값은 지속적으로 감소했고, 모델의 응답 길이도 최적화되면서 학습의 효율성이 극대화되었습니다.

R1-V GitHub 저장소

R1-V GitHub 저장소

https://github.com/Deep-Agent/R1-V

더 읽어보기

-

SFT Memorizes, RL Generalizes: Foundation Model의 사후 학습 방법에 대한 비교 연구

-

DeepSeek-R1, 지도학습 기반 파인튜닝(SFT) 대신, 강화학습(RL)으로 추론 능력을 개선하여 추론 능력을 강화한 대규모 언어 모델

이 글은 GPT 모델로 정리한 글을 바탕으로 한 것으로, 원문의 내용 또는 의도와 다르게 정리된 내용이 있을 수 있습니다. 관심있는 내용이시라면 원문도 함께 참고해주세요! 읽으시면서 어색하거나 잘못된 내용을 발견하시면 덧글로 알려주시기를 부탁드립니다. ![]()

파이토치 한국 사용자 모임

![]() 이 정리한 이 글이 유용하셨나요? 회원으로 가입하시면 주요 글들을 이메일

이 정리한 이 글이 유용하셨나요? 회원으로 가입하시면 주요 글들을 이메일![]() 로 보내드립니다! (기본은 Weekly지만 Daily로 변경도 가능합니다.)

로 보내드립니다! (기본은 Weekly지만 Daily로 변경도 가능합니다.)

![]() 아래

아래![]() 쪽에 좋아요

쪽에 좋아요![]() 를 눌러주시면 새로운 소식들을 정리하고 공유하는데 힘이 됩니다~

를 눌러주시면 새로운 소식들을 정리하고 공유하는데 힘이 됩니다~ ![]()