Jackrong LLM Fine-Tuning Guide 소개

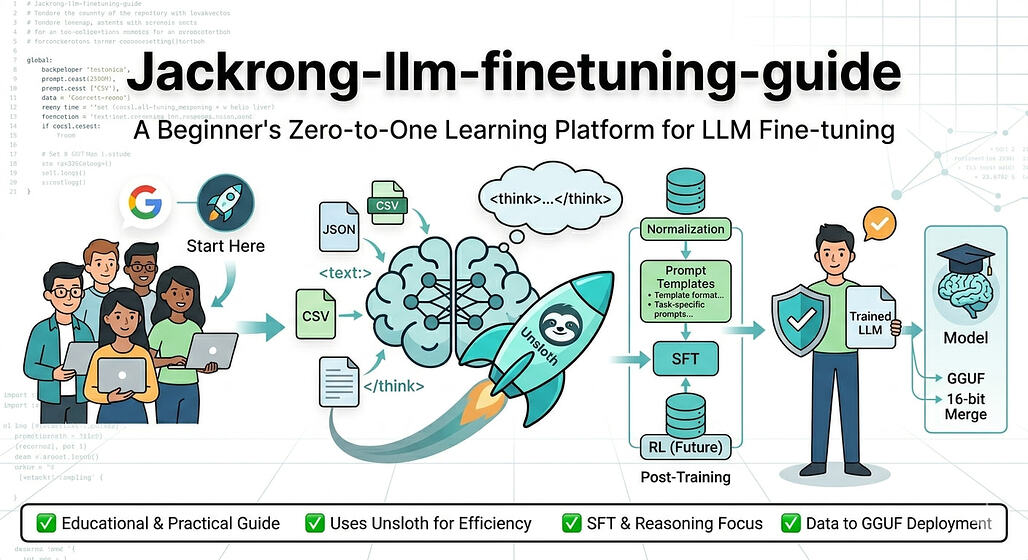

대형 언어 모델(LLM, Large Language Model)을 특정 도메인에 맞게 파인튜닝(fine-tuning)하는 작업은 대규모 GPU 클러스터와 전문적인 인프라 지식을 요구한다는 인식이 있었습니다. 그러나 LoRA(Low-Rank Adaptation)와 4비트 양자화 기술의 발전, 그리고 Unsloth와 같은 경량화 프레임워크의 등장으로, 개인 연구자도 단일 GPU에서 수십억 파라미터 규모의 모델을 파인튜닝할 수 있게 되었습니다. Jackrong LLM Fine-Tuning Guide는 이러한 변화를 누구나 쉽게 활용할 수 있도록 체계적으로 정리한 실전 교육용 저장소입니다.

Jackrong LLM Fine-Tuning Guide 프로젝트는 "파인튜닝, 사후 학습(post-training), 소규모 사전 학습(pretraining)은 접근 불가능한 기술적 의식이 아니라 학습 가능한 공학적 실천"이라는 철학 아래, 브라우저와 무료 클라우드 컴퓨팅 환경(Google Colab, Kaggle)만으로 전체 파인튜닝 파이프라인을 경험할 수 있도록 설계되었습니다. GitHub에서 689개의 스타를 기록하고 있으며, 이 가이드를 통해 파인튜닝된 Qwen3.5 모델들은 HuggingFace에서 누적 100만 회 이상 다운로드되어 실용성을 입증하고 있습니다.

프로젝트는 영어, 중국어, 한국어, 일본어 다국어 문서를 제공하며, 24개의 고품질 데이터셋을 HuggingFace를 통해 함께 공개하여 데이터 수집 부담도 줄여줍니다. DeepSeek-V3.2, Qwen3-235B, GLM-4.7, GPT-OSS-120B 등 대형 플래그십 모델에서 증류(distillation)된 데이터셋은 추론, 수학, 코딩, 멀티턴 대화 등 다양한 카테고리를 포함합니다.

Jackrong Guide가 지원하는 모델과 학습 기법

현재 저장소에서 지원하는 모델로는 Qwopus 3.5 (27B, 35B) 및 Qwen 3.5 (9B)에 대한 지도 학습 파인튜닝(SFT, Supervised Fine-Tuning) 노트북, 그리고 Llama 3.2-R1 (3B)에 대한 강화학습 기반 GRPO(Group Relative Policy Optimization) 파인튜닝 노트북이 포함됩니다. 추가로 Qwen 3, Llama 3.1/3.3, Phi-4, Gemma 4, DeepSeek 모델 지원이 예정되어 있습니다.

학습 파이프라인은 데이터 정규화(normalization), LoRA 어댑터(adapter) 적용, 16비트 모델 병합(merging), GGUF 포맷 양자화까지의 전 과정을 커버합니다. Unsloth 라이브러리와 4비트 양자화를 결합하여 Colab의 T4 GPU(무료 티어) 환경에서도 27B 파라미터 모델 학습이 가능하도록 메모리 효율을 극대화합니다.

설치 없이 One-Click으로 시작하기

별도의 환경 설정 없이 아래 노트북을 열어 바로 학습을 시작할 수 있습니다.

| Qwopus3.5 (27B) | SFT | |

| Qwen3.5 (9B) | SFT | |

| Qwopus3.5 (35B) | SFT | |

| Llama3.2-R1 (3B) | RL (GPRO) |

로컬 환경에서 학습하거나 데이터셋을 직접 준비하려는 경우, 저장소를 클론하고 데이터셋 다운로드 스크립트를 사용할 수 있습니다.

git clone https://github.com/R6410418/Jackrong-llm-finetuning-guide.git

cd Jackrong-llm-finetuning-guide

python download_datasets.py

LoRA + Unsloth 기반 SFT 핵심 코드

from unsloth import FastLanguageModel

import torch

# 4비트 양자화로 27B 모델 로드

model, tokenizer = FastLanguageModel.from_pretrained(

model_name="unsloth/Qwopus3.5-27B-bnb-4bit",

max_seq_length=2048,

dtype=None,

load_in_4bit=True,

)

# LoRA 어댑터 설정

model = FastLanguageModel.get_peft_model(

model,

r=16, # LoRA rank

target_modules=["q_proj", "v_proj", "k_proj", "o_proj"],

lora_alpha=16,

lora_dropout=0,

bias="none",

use_gradient_checkpointing="unsloth", # 메모리 절약

)

# 학습 후 GGUF로 내보내기 (로컬 배포용)

model.save_pretrained_gguf("model_gguf", tokenizer, quantization_method="q4_k_m")

LoRA를 사용하면 전체 모델 파라미터가 아닌 소규모 행렬만 학습하므로, 원본 모델 가중치는 고정된 상태로 메모리 효율적인 학습이 가능합니다. 학습이 완료된 LoRA 어댑터는 원본 모델에 병합하거나 GGUF 포맷으로 변환하여 Ollama, llama.cpp 등 로컬 추론 도구에 바로 배포할 수 있습니다.

라이선스

Jackrong LLM Fine-Tuning Guide 프로젝트는 Apache-2.0 라이선스로 공개되어 있어 학술 및 상업적 목적으로 자유롭게 사용, 수정, 배포할 수 있습니다.

Jackrong LLM Fine-Tuning Guide GitHub 저장소

Jackrong LLM Fine-Tuning Guide GitHub 저장소

더 읽어보기

-

Unsloth AI, 자사의 Unsloth 프레임워크를 사용하여 Google Colab에서 DeepSeek-OCR 실행 및 파인튜닝하는 문서 공개

-

Auto Research: AI 에이전트가 사람을 대신해 스스로 모델 연구와 학습을 수행하는 'Vibe Training' 프로젝트 (feat. Andrej Karpathy)

-

Deep Researcher Agent: 잠든 사이에도 24시간 딥러닝 실험을 자율 수행하는 LLM 에이전트 프레임워크

-

Agentic Researcher: 수학 및 머신러닝 분야에서 인공지능 도구들을 활용하는 현실적인 연구 방법에 대한 논문

이 글은 GPT 모델로 정리한 글을 바탕으로 한 것으로, 원문의 내용 또는 의도와 다르게 정리된 내용이 있을 수 있습니다. 관심있는 내용이시라면 원문도 함께 참고해주세요! 읽으시면서 어색하거나 잘못된 내용을 발견하시면 덧글로 알려주시기를 부탁드립니다. ![]()

파이토치 한국 사용자 모임

![]() 이 정리한 이 글이 유용하셨나요? 회원으로 가입하시면 주요 글들을 이메일

이 정리한 이 글이 유용하셨나요? 회원으로 가입하시면 주요 글들을 이메일![]() 로 보내드립니다! (기본은 Weekly지만 Daily로 변경도 가능합니다.)

로 보내드립니다! (기본은 Weekly지만 Daily로 변경도 가능합니다.)

![]() 아래

아래![]() 쪽에 좋아요

쪽에 좋아요![]() 를 눌러주시면 새로운 소식들을 정리하고 공유하는데 힘이 됩니다~

를 눌러주시면 새로운 소식들을 정리하고 공유하는데 힘이 됩니다~ ![]()